–У—А–∞–і—Ц—Ф–љ—В–љ—Ц –Љ–µ—В–Њ–і–Є

–Ь—Ц–љ—Ц—Б—В–µ—А—Б—В–≤–Њ –Њ—Б–≤—Ц—В–Є —Ц –љ–∞—Г–Ї–Є –£–Ї—А–∞—Ч–љ–Є

–Э–Ґ–£–£ –Ъ–Я–Ж

–Ъ–∞—Д–µ–і—А–∞ –Р–Я–Х–Я–°

–Ы–∞–±–Њ—А–∞—В–Њ—А–љ–∞ —А–Њ–±–Њ—В–∞

–њ–Њ —В–µ–Љ—Ц "–У—А–∞–і—Ц—Ф–љ—В–љ—Ц –Љ–µ—В–Њ–і–Є"

–Т–Є–Ї–Њ–љ–∞–ї–∞

—Б—В. 3-–≥–Њ –Ї—Г—А—Б—Г

–Ґ–Х–§, –≥—А. –Ґ–Ь-81

–Ъ–Њ—И–µ–≤–∞ –Р.–°.

–Ъ–Є—Ч–≤ 2010

1. –Ъ–Њ—А–Њ—В–Ї—Ц —В–µ–Њ—А–µ—В–Є—З–љ—Ц –≤—Ц–і–Њ–Љ–Њ—Б—В—Ц

1.1 –Я—А–Њ —З–Є—Б–µ–ї—М–љ—Ц –Љ–µ—В–Њ–і–Є –±–∞–≥–∞—В–Њ–Љ—Ц—А–љ–Њ—Ч –Њ–њ—В–Є–Љ—Ц–Ј–∞—Ж—Ц—Ч

–Ь–µ—В–∞ —А–Њ–±–Њ—В–Є: –Ј–љ–∞–є–Њ–Љ—Б—В–≤–Њ –Ј –Љ–µ—В–Њ–і–∞–Љ–Є –±–∞–≥–∞—В–Њ–Љ—Ц—А–љ–Њ—Ч –±–µ–Ј—Г–Љ–Њ–≤–љ–Њ—Ч –Њ–њ—В–Є–Љ—Ц–Ј–∞—Ж—Ц—Ч –њ–µ—А—И–Њ–≥–Њ –є –љ—Г–ї—М–Њ–≤–Њ–≥–Њ –њ–Њ—А—П–і–Ї—Ц–≤ —Ц —Ч—Е–љ—Ф –Ј–∞—Б–≤–Њ—Ф–љ–љ—П, –њ–Њ—А—Ц–≤–љ—П–љ–љ—П –µ—Д–µ–Ї—В–Є–≤–љ–Њ—Б—В—Ц –Ј–∞—Б—В–Њ—Б—Г–≤–∞–љ–љ—П —Ж–Є—Е –Љ–µ—В–Њ–і—Ц–≤ –і–ї—П –Ї–Њ–љ–Ї—А–µ—В–љ–Є—Е —Ж—Ц–ї—М–Њ–≤–Є—Е —Д—Г–љ–Ї—Ж—Ц–є.

–Ч–∞–і–∞—З–∞ –±–∞–≥–∞—В–Њ–Љ—Ц—А–љ–Њ—Ч –±–µ–Ј—Г–Љ–Њ–≤–љ–Њ—Ч –Њ–њ—В–Є–Љ—Ц–Ј–∞—Ж—Ц—Ч —Д–Њ—А–Љ—Г–ї—О—Ф—В—М—Б—П —Г –≤–Є–≥–ї—П–і—Ц:

–і–µ x={x (1), x (2), вА¶, x (n) } - —В–Њ—З–Ї–∞ –≤ n-–Љ—Ц—А–љ–Њ–Љ—Г –њ—А–Њ—Б—В–Њ—А—Ц X=IRn, —В–Њ–±—В–Њ —Ж—Ц–ї—М–Њ–≤–∞ —Д—Г–љ–Ї—Ж—Ц—П f (x) =f (x (1),вА¶,f (x (n)) - —Д—Г–љ–Ї—Ж—Ц—П n –∞—А–≥—Г–Љ–µ–љ—В—Ц–≤.

–Ґ–∞–Ї —Б–∞–Љ–Њ —П–Ї —Ц –≤ –њ–µ—А—И—Ц–є –ї–∞–±–Њ—А–∞—В–Њ—А–љ—Ц–є —А–Њ–±–Њ—В—Ц –Љ–Є —А–Њ–Ј–≥–ї—П–і–∞—Ф–Љ–Њ –Ј–∞–і–∞—З—Г –Љ—Ц–љ—Ц–Љ—Ц–Ј–∞—Ж—Ц—Ч. –І–Є—Б–µ–ї—М–љ—Ц –Љ–µ—В–Њ–і–Є –≤—Ц–і—И—Г–Ї–∞–љ–љ—П –Љ—Ц–љ—Ц–Љ—Г–Љ—Г, —П–Ї –њ—А–∞–≤–Є–ї–Њ, —Б–Ї–ї–∞–і–∞—О—В—М—Б—П –≤ –њ–Њ–±—Г–і–Њ–≤—Ц –њ–Њ—Б–ї—Ц–і–Њ–≤–љ–Њ—Б—В—Ц —В–Њ—З–Њ–Ї {x>k>}, —Й–Њ –Ј–∞–і–Њ–≤–Њ–ї—М–љ—П—О—В—М —Г–Љ–Њ–≤—Ц f (x>0>) >f (x>1>) >вА¶>f (x>n>) >вА¶. –Ь–µ—В–Њ–і–Є –њ–Њ–±—Г–і–Њ–≤–Є —В–∞–Ї–Є—Е –њ–Њ—Б–ї—Ц–і–Њ–≤–љ–Њ—Б—В–µ–є –љ–∞–Ј–Є–≤–∞—О—В—М—Б—П –Љ–µ—В–Њ–і–∞–Љ–Є —Б–њ—Г—Б–Ї—Г. –£ —Ж–Є—Е –Љ–µ—В–Њ–і–∞—Е —В–Њ—З–Ї–Є –њ–Њ—Б–ї—Ц–і–Њ–≤–љ–Њ—Б—В—Ц {x>k>} –Њ–±—З–Є—Б–ї—О—О—В—М—Б—П –Ј–∞ —Д–Њ—А–Љ—Г–ї–Њ—О:

—Е>k+1> = x>k> + пБ°>k>p>k>, k=0,1,2,вА¶,

–і–µ p>k> - –љ–∞–њ—А—П–Љ–Њ–Ї —Б–њ—Г—Б–Ї—Г, пБ°>k> - –і–Њ–≤–ґ–Є–љ–∞ –Ї—А–Њ–Ї—Г –≤ —Ж—М–Њ–Љ—Г –љ–∞–њ—А—П–Љ–Ї—Г.

–†—Ц–Ј–љ—Ц –Љ–µ—В–Њ–і–Є —Б–њ—Г—Б–Ї–∞ –≤—Ц–і—А—Ц–Ј–љ—П—О—В—М—Б—П –і—А—Г–≥ –≤—Ц–і –і—А—Г–≥–∞ —Б–њ–Њ—Б–Њ–±–∞–Љ–Є –≤–Є–±–Њ—А—Г –љ–∞–њ—А—П–Љ–Ї—Г —Б–њ—Г—Б–Ї–∞ p>k> —Ц –і–Њ–≤–ґ–Є–љ–Є –Ї—А–Њ–Ї—Г пБ°>k> —Г–Ј–і–Њ–≤–ґ —Ж—М–Њ–≥–Њ –љ–∞–њ—А—П–Љ–Ї—Г. –Р–ї–≥–Њ—А–Є—В–Љ–Є –±–µ–Ј—Г–Љ–Њ–≤–љ–Њ—Ч –Љ—Ц–љ—Ц–Љ—Ц–Ј–∞—Ж—Ц—Ч –њ—А–Є–є–љ—П—В–Њ –і—Ц–ї–Є—В–Є –љ–∞ –Ї–ї–∞—Б–Є, –Ј–∞–ї–µ–ґ–љ–Њ –≤—Ц–і –Љ–∞–Ї—Б–Є–Љ–∞–ї—М–љ–Њ–≥–Њ –њ–Њ—А—П–і–Ї—Г –њ–Њ—Е—Ц–і–љ–Є—Е —Д—Г–љ–Ї—Ж—Ц—Ч, —Й–Њ –Љ—Ц–љ—Ц–Љ—Ц–Ј—Г—Ф—В—М—Б—П, –Њ–±—З–Є—Б–ї–µ–љ–љ—П —П–Ї–Є—Е –њ–µ—А–µ–і–±–∞—З–∞—Ф—В—М—Б—П. –Ґ–∞–Ї, –Љ–µ—В–Њ–і–Є, —Й–Њ –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г—О—В—М —В—Ц–ї—М–Ї–Є –Ј–љ–∞—З–µ–љ–љ—П —Б–∞–Љ–Њ—Ч —Ж—Ц–ї—М–Њ–≤–Њ—Ч —Д—Г–љ–Ї—Ж—Ц—Ч, –≤—Ц–і–љ–Њ—Б—П—В—М –і–Њ –Љ–µ—В–Њ–і—Ц–≤ –љ—Г–ї—М–Њ–≤–Њ–≥–Њ –њ–Њ—А—П–і–Ї—Г (—Ц–љ–Њ–і—Ц —Ч—Е –љ–∞–Ј–Є–≤–∞—О—В—М —В–∞–Ї–Њ–ґ –Љ–µ—В–Њ–і–∞–Љ–Є –њ—А—П–Љ–Њ–≥–Њ –њ–Њ—И—Г–Ї—Г); —П–Ї—Й–Њ, –Ї—А—Ц–Љ —В–Њ–≥–Њ, –њ–Њ—В—А—Ц–±–љ–µ –Њ–±—З–Є—Б–ї–µ–љ–љ—П –њ–µ—А—И–Є—Е –њ–Њ—Е—Ц–і–љ–Є—Е —Д—Г–љ–Ї—Ж—Ц—Ч, —Й–Њ –Љ—Ц–љ—Ц–Љ—Ц–Ј—Г—Ф—В—М—Б—П, —В–Њ –Љ–Є –Љ–∞—Ф–Љ–Њ —Б–њ—А–∞–≤—Г –Ј –Љ–µ—В–Њ–і–∞–Љ–Є –њ–µ—А—И–Њ–≥–Њ –њ–Њ—А—П–і–Ї—Г; —П–Ї—Й–Њ –ґ –і–Њ–і–∞—В–Ї–Њ–≤–Њ –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г—О—В—М—Б—П –і—А—Г–≥—Ц –њ–Њ—Е—Ц–і–љ—Ц, —В–µ —Ж–µ –Љ–µ—В–Њ–і–Є –і—А—Г–≥–Њ–≥–Њ –њ–Њ—А—П–і–Ї—Г –є —В.–і.

1.2 –У—А–∞–і—Ц—Ф–љ—В–љ—Ц –Љ–µ—В–Њ–і–Є

1.2.1 –Ч–∞–≥–∞–ї—М–љ–∞ —Б—Е–µ–Љ–∞ –≥—А–∞–і—Ц—Ф–љ—В–љ–Њ–≥–Њ —Б–њ—Г—Б–Ї—Г

–ѓ–Ї –≤—Ц–і–Њ–Љ–Њ, –≥—А–∞–і—Ц—Ф–љ—В

—Д—Г–љ–Ї—Ж—Ц—Ч –≤ –і–µ—П–Ї—Ц–є —В–Њ—З—Ж—Ц x>k>

—Б–њ—А—П–Љ–Њ–≤–∞–љ–Є–є –≤ –±—Ц–Ї –љ–∞–є—И–≤–Є–і—И–Њ–≥–Њ –ї–Њ–Ї–∞–ї—М–љ–Њ–≥–Њ

–Ј—А–Њ—Б—В–∞–љ–љ—П —Д—Г–љ–Ї—Ж—Ц—Ч –є –њ–µ—А–њ–µ–љ–і–Є–Ї—Г–ї—П—А–љ–Є–є

–ї—Ц–љ—Ц—Ч —А—Ц–≤–љ—П (–њ–Њ–≤–µ—А—Е–љ—П –њ–Њ—Б—В—Ц–є–љ–Њ–≥–Њ –Ј–љ–∞—З–µ–љ–љ—П

—Д—Г–љ–Ї—Ж—Ц—Ч f (x), —Й–Њ –њ—А–Њ—Е–Њ–і–Є—В—М —З–µ—А–µ–Ј —В–Њ—З–Ї—Г

x>k>).

–Т–µ–Ї—В–Њ—А, –њ—А–Њ—В–Є–ї–µ–ґ–љ–Є–є –≥—А–∞–і—Ц—Ф–љ—В—Г

,

–љ–∞–Ј–Є–≤–∞—Ф—В—М—Б—П –∞–љ—В–Є–≥—А–∞–і—Ц—Ф–љ—В–Њ–Љ, —Й–Њ —Б–њ—А—П–Љ–Њ–≤–∞–љ–Є–є

—Г–±—Ц–Ї –љ–∞–є—И–≤–Є–і—И–Њ–≥–Њ —Г–±—Г–≤–∞–љ–љ—П —Д—Г–љ–Ї—Ж—Ц—Ч f

(x). –Т–Є–±–Є—А–∞—О—З–Є —П–Ї –љ–∞–њ—А—П–Љ–Њ–Ї —Б–њ—Г—Б–Ї–∞ p>k>

–∞–љ—В–Є–≥—А–∞–і—Ц—Ф–љ—В -

,

–љ–∞–Ј–Є–≤–∞—Ф—В—М—Б—П –∞–љ—В–Є–≥—А–∞–і—Ц—Ф–љ—В–Њ–Љ, —Й–Њ —Б–њ—А—П–Љ–Њ–≤–∞–љ–Є–є

—Г–±—Ц–Ї –љ–∞–є—И–≤–Є–і—И–Њ–≥–Њ —Г–±—Г–≤–∞–љ–љ—П —Д—Г–љ–Ї—Ж—Ц—Ч f

(x). –Т–Є–±–Є—А–∞—О—З–Є —П–Ї –љ–∞–њ—А—П–Љ–Њ–Ї —Б–њ—Г—Б–Ї–∞ p>k>

–∞–љ—В–Є–≥—А–∞–і—Ц—Ф–љ—В -

—Г —В–Њ—З—Ж—Ц x>k>,

–Љ–Є –њ—А–Є—Е–Њ–і–Є–Љ–Њ –і–Њ —Ц—В–µ—А–∞—Ж—Ц–є–љ–Њ–≥–Њ –њ—А–Њ—Ж–µ—Б—Г

–≤–Є–і—Г:

—Г —В–Њ—З—Ж—Ц x>k>,

–Љ–Є –њ—А–Є—Е–Њ–і–Є–Љ–Њ –і–Њ —Ц—В–µ—А–∞—Ж—Ц–є–љ–Њ–≥–Њ –њ—А–Њ—Ж–µ—Б—Г

–≤–Є–і—Г:

x>k+1> = x>k> - пБ°>k> fвАЩ (x>k>), пБ°>k>>0, k=0, 1, 2, вА¶

–£ –Ї–Њ–Њ—А–і–Є–љ–∞—В–љ—Ц–є —Д–Њ—А–Љ—Ц —Ж–µ–є –њ—А–Њ—Ж–µ—Б –Ј–∞–њ–Є—Б—Г—Ф—В—М—Б—П –≤ —В–∞–Ї–Є–є —Б–њ–Њ—Б—Ц–±:

–Т—Б—Ц —Ц—В–µ—А–∞—Ж—Ц–є–љ—Ц –њ—А–Њ—Ж–µ—Б–Є, —Г —П–Ї–Є—Е –љ–∞–њ—А—П–Љ–Њ–Ї —А—Г—Е—Г –љ–∞ –Ї–Њ–ґ–љ–Њ–Љ—Г –Ї—А–Њ—Ж—Ц –Ј–±—Ц–≥–∞—Ф—В—М—Б—П –Ј –∞–љ—В–Є–≥—А–∞–і—Ц—Ф–љ—В–Њ–Љ —Д—Г–љ–Ї—Ж—Ц—Ч, –љ–∞–Ј–Є–≤–∞—О—В—М—Б—П –≥—А–∞–і—Ц—Ф–љ—В–љ–Є–Љ–Є –Љ–µ—В–Њ–і–∞–Љ–Є. –Т–Њ–љ–Є –≤—Ц–і—А—Ц–Ј–љ—П—О—В—М—Б—П –і—А—Г–≥ –≤—Ц–і –і—А—Г–≥–∞ —В—Ц–ї—М–Ї–Є —Б–њ–Њ—Б–Њ–±–Њ–Љ –≤–Є–±–Њ—А—Г –Ї—А–Њ–Ї—Г пБ°>k>. –Ж—Б–љ—Г—Ф –±–∞–≥–∞—В–Њ —А—Ц–Ј–љ–Є—Е —Б–њ–Њ—Б–Њ–±—Ц–≤ –≤–Є–±–Њ—А—Г пБ°>k>, –∞–ї–µ –љ–∞–є–њ–Њ—И–Є—А–µ–љ—Ц—И—Ц: –Љ–µ—В–Њ–і –Ј –њ–Њ—Б—В—Ц–є–љ–Є–Љ –Ї—А–Њ–Ї–Њ–Љ, –Љ–µ—В–Њ–і —Ц–Ј –і—А–Њ–±–ї–µ–љ–љ—П–Љ –Ї—А–Њ–Ї—Г –є –Љ–µ—В–Њ–і –љ–∞–є—И–≤–Є–і—И–Њ–≥–Њ —Б–њ—Г—Б–Ї–∞.

1.2.4 –Ь–µ—В–Њ–і –љ–∞–є—И–≤–Є–і—И–Њ–≥–Њ —Б–њ—Г—Б–Ї–∞

–£ –≥—А–∞–і—Ц—Ф–љ—В–љ–Њ–Љ—Г –Љ–µ—В–Њ–і—Ц –Ј –њ–Њ—Б—В—Ц–є–љ–Є–Љ –Ї—А–Њ–Ї–Њ–Љ –≤–µ–ї–Є—З–Є–љ–∞ –Ї—А–Њ–Ї—Г, —Й–Њ –Ј–∞–±–µ–Ј–њ–µ—З—Г—Ф —Г–±—Г–≤–∞–љ–љ—П —Д—Г–љ–Ї—Ж—Ц—Ч f (x) –≤—Ц–і —Ц—В–µ—А–∞—Ж—Ц—Ч –і–Њ —Ц—В–µ—А–∞—Ж—Ц—Ч, –≤–Є—П–≤–ї—П—Ф—В—М—Б—П –і—Г–ґ–µ –Љ–∞–ї–Њ—Ч, —Й–Њ –њ—А–Є–≤–Њ–і–Є—В—М –і–Њ –љ–µ–Њ–±—Е—Ц–і–љ–Њ—Б—В—Ц –њ—А–Њ–≤–Њ–і–Є—В–Є –≤–µ–ї–Є–Ї—Г –Ї—Ц–ї—М–Ї—Ц—Б—В—М —Ц—В–µ—А–∞—Ж—Ц—Ч –і–ї—П –і–Њ—Б—П–≥–љ–µ–љ–љ—П —В–Њ—З–Ї–Є –Љ—Ц–љ—Ц–Љ—Г–Љ—Г. –Ґ–Њ–Љ—Г –Љ–µ—В–Њ–і–Є —Б–њ—Г—Б–Ї–∞ –Ј—Ц –Ј–Љ—Ц–љ–љ–Є–Љ –Ї—А–Њ–Ї–Њ–Љ —Ф –±—Ц–ї—М—И–µ –Њ—Й–∞–і–ї–Є–≤–Є–Љ–Є. –Р–ї–≥–Њ—А–Є—В–Љ, –љ–∞ –Ї–Њ–ґ–љ—Ц–є —Ц—В–µ—А–∞—Ж—Ц—Ч —П–Ї–Њ–≥–Њ –Ї—А–Њ–Ї пБ°>–і–Њ> –≤–Є–±–Є—А–∞—Ф—В—М—Б—П –Ј —Г–Љ–Њ–≤–Є –Љ—Ц–љ—Ц–Љ—Г–Љ—Г —Д—Г–љ–Ї—Ж—Ц—Ч f (x) —Г –љ–∞–њ—А—П–Љ–Ї—Г —А—Г—Е—Г, —В–Њ–±—В–Њ:

–љ–∞–Ј–Є–≤–∞—Ф—В—М—Б—П –Љ–µ—В–Њ–і–Њ–Љ –љ–∞–є—И–≤–Є–і—И–Њ–≥–Њ —Б–њ—Г—Б–Ї–∞. –Ч—А–Њ–Ј—Г–Љ—Ц–ї–Њ, —Ж–µ–є —Б–њ–Њ—Б—Ц–± –≤–Є–±–Њ—А—Г пБ°>–і–Њ> —Б–Ї–ї–∞–і–љ—Ц—И–µ —А–∞–љ—Ц—И–µ —А–Њ–Ј–≥–ї—П–љ—Г—В–Є—Е –≤–∞—А—Ц–∞–љ—В—Ц–≤.

–†–µ–∞–ї—Ц–Ј–∞—Ж—Ц—П –Љ–µ—В–Њ–і—Г

–љ–∞–є—И–≤–Є–і—И–Њ–≥–Њ —Б–њ—Г—Б–Ї–∞ –њ—А–Є–њ—Г—Б–Ї–∞—Ф —А—Ц—И–µ–љ–љ—П

–љ–∞ –Ї–Њ–ґ–љ—Ц–є —Ц—В–µ—А–∞—Ж—Ц—Ч –і–Њ—Б–Є—В—М —В—А—Г–і–Њ–Љ—Ц—Б—В–Ї–Њ—Ч

–і–Њ–њ–Њ–Љ—Ц–ґ–љ–Њ—Ч –Ј–∞–і–∞—З—Ц –Њ–і–љ–Њ–Љ—Ц—А–љ–Њ—Ч –Љ—Ц–љ—Ц–Љ—Ц–Ј–∞—Ж—Ц—Ч.

–ѓ–Ї –њ—А–∞–≤–Є–ї–Њ, –Љ–µ—В–Њ–і –љ–∞–є—И–≤–Є–і—И–Њ–≥–Њ —Б–њ—Г—Б–Ї–∞,

–њ—А–Њ—В–µ, –і–∞—Ф –≤–Є–≥—А–∞—И —Г —З–Є—Б–ї—Ц –Љ–∞—И–Є–љ–љ–Є—Е

–Њ–њ–µ—А–∞—Ж—Ц–є, –Њ—Б–Ї—Ц–ї—М–Ї–Є –Ј–∞–±–µ–Ј–њ–µ—З—Г—Ф —А—Г—Е —Ц–Ј

—Б–∞–Љ–Є–Љ –≤–Є–≥—Ц–і–љ–Є–Љ –Ї—А–Њ–Ї–Њ–Љ, —В–Њ–Љ—Г —Й–Њ —А—Ц—И–µ–љ–љ—П

–Ј–∞–і–∞—З—Ц –Њ–і–љ–Њ–Љ—Ц—А–љ–Њ—Ч –Љ—Ц–љ—Ц–Љ—Ц–Ј–∞—Ж—Ц—Ч –њ–Њ–≤'—П–Ј–∞–љ–µ

–Ј –і–Њ–і–∞—В–Ї–Њ–≤–Є–Љ–Є –Њ–±—З–Є—Б–ї–µ–љ–љ—П–Љ–Є —В—Ц–ї—М–Ї–Є —Б–∞–Љ–Њ—Ч

—Д—Г–љ–Ї—Ж—Ц—Ч f (x), —В–Њ–і—Ц —П–Ї –Њ—Б–љ–Њ–≤–љ–Є–є –Љ–∞—И–Є–љ–љ–Є–є

—З–∞—Б –≤–Є—В—А–∞—З–∞—Ф—В—М—Б—П –љ–∞ –Њ–±—З–Є—Б–ї–µ–љ–љ—П —Ч—Ч

–≥—А–∞–і—Ц—Ф–љ—В–∞

.

.

–Т–∞—А—В–Њ –Љ–∞—В–Є –љ–∞ —Г–≤–∞–Ј—Ц, —Й–Њ –Њ–і–љ–Њ–Љ—Ц—А–љ—Г –Љ—Ц–љ—Ц–Љ—Ц–Ј–∞—Ж—Ц—О –Љ–Њ–ґ–љ–∞ —А–Њ–±–Є—В–Є –±—Г–і—М-—П–Ї–Є–Љ –Љ–µ—В–Њ–і–Њ–Љ –Њ–і–љ–Њ–Љ—Ц—А–љ–Њ—Ч –Њ–њ—В–Є–Љ—Ц–Ј–∞—Ж—Ц—Ч, —Й–Њ –њ–Њ—А–Њ–і–ґ—Г—Ф —А—Ц–Ј–љ—Ц –≤–∞—А—Ц–∞–љ—В–Є –Љ–µ—В–Њ–і—Г –љ–∞–є—И–≤–Є–і—И–Њ–≥–Њ —Б–њ—Г—Б–Ї–∞.

–°—Е–µ–Љ–∞ –∞–ї–≥–Њ—А–Є—В–Љ—Г

–Ъ—А–Њ–Ї 1.

–Ч–∞–і–∞—О—В—М—Б—П —Е>0>,

пБ•>3>.

–Ю–±—З–Є—Б–ї—О—Ф—В—М—Б—П –≥—А–∞–і—Ц—Ф–љ—В

,

–љ–∞–њ—А—П–Љ–Њ–Ї –њ–Њ—И—Г–Ї—Г.

,

–љ–∞–њ—А—П–Љ–Њ–Ї –њ–Њ—И—Г–Ї—Г.

–Я—А–Є–≤–ї–∞—Б–љ—О—Ф—В—М—Б—П –і–Њ=0.

–Ъ—А–Њ–Ї 2.

–Т–Є–Ј–љ–∞—З–∞—Ф—В—М—Б—П —В–Њ—З–Ї–∞ —З–µ—А–≥–Њ–≤–Њ–≥–Њ –µ–Ї—Б–њ–µ—А–Є–Љ–µ–љ—В—Г:

—Е>–Ї+1>

= —Е>–Ї>

- пБ°>–і–Њ> ,

,

–і–µ пБ°>–і–Њ> - –Љ—Ц–љ—Ц–Љ—Г–Љ –Ј–∞–і–∞—З—Ц –Њ–і–љ–Њ–Љ—Ц—А–љ–Њ—Ч –Љ—Ц–љ—Ц–Љ—Ц–Ј–∞—Ж—Ц—Ч:

–Ъ—А–Њ–Ї 3.

–Ю–±—З–Є—Б–ї—О—Ф—В—М—Б—П

–Ј–љ–∞—З–µ–љ–љ—П –≥—А–∞–і—Ц—Ф–љ—В–∞ –≤ —В–Њ—З—Ж—Ц —Е>–Ї+1>:

.

.

–Ъ—А–Њ–Ї 4.

–ѓ–Ї—Й–Њ || ||пВ£пБ•>3>,

—В–Њ –њ–Њ—И—Г–Ї —В–Њ—З–Ї–Є –Љ—Ц–љ—Ц–Љ—Г–Љ—Г –Ј–∞–Ї—Ц–љ—З—Г—Ф—В—М—Б—П

–є –њ–Њ–Ї–ї–∞–і–∞—Ф—В—М—Б—П:

||пВ£пБ•>3>,

—В–Њ –њ–Њ—И—Г–Ї —В–Њ—З–Ї–Є –Љ—Ц–љ—Ц–Љ—Г–Љ—Г –Ј–∞–Ї—Ц–љ—З—Г—Ф—В—М—Б—П

–є –њ–Њ–Ї–ї–∞–і–∞—Ф—В—М—Б—П:

–Ж–љ–∞–Ї—И–µ –і–Њ=–і–Њ+1 —Ц –њ–µ—А–µ—Е—Ц–і –і–Њ –Ї—А–Њ–Ї—Г 2.

1.5 –Ь–µ—В–Њ–і–Є —П—А—Ц–≤

1.5.1 –Ч–∞–≥–∞–ї—М–љ–∞ —Е–∞—А–∞–Ї—В–µ—А–Є—Б—В–Є–Ї–∞

–У—А–∞–і—Ц—Ф–љ—В–љ—Ц –Љ–µ—В–Њ–і–Є –њ–Њ–≤—Ц–ї—М–љ–Њ —Б—Е–Њ–і—П—В—М—Б—П –≤ —В–Є—Е –≤–Є–њ–∞–і–Ї–∞—Е, –Ї–Њ–ї–Є –њ–Њ–≤–µ—А—Е–љ—Ц —А—Ц–≤–љ—П —Ж—Ц–ї—М–Њ–≤–Њ—Ч —Д—Г–љ–Ї—Ж—Ц—Ч f (x) —Б–Є–ї—М–љ–Њ –≤–Є—В—П–≥–љ—Г—В—Ц. –¶–µ–є —Д–∞–Ї—В –≤—Ц–і–Њ–Љ–Є–є —Г –ї—Ц—В–µ—А–∞—В—Г—А—Ц —П–Ї "–µ—Д–µ–Ї—В —П—А—Ц–≤". –°—Г—В—М –µ—Д–µ–Ї—В—Г –≤ —В—Ц–Љ, —Й–Њ –љ–µ–≤–µ–ї–Є–Ї—Ц –Ј–Љ—Ц–љ–Є –Њ–і–Є–љ –Ј–Љ—Ц–љ–љ–Є—Е –њ—А–Є–≤–Њ–і—П—В—М –і–Њ —А—Ц–Ј–Ї–Њ—Ч –Ј–Љ—Ц–љ–Є –Ј–љ–∞—З–µ–љ—М —Д—Г–љ–Ї—Ж—Ц—Ч - —Ж—П –≥—А—Г–њ–∞ –Ј–Љ—Ц–љ–љ–Є—Е —Е–∞—А–∞–Ї—В–µ—А–Є–Ј—Г—Ф "—Б—Е–Є–ї —П—А—Г", –∞ –њ–Њ —Ц–љ—И–Є–Љ –Ј–Љ—Ц–љ–љ–Є–Љ, —Й–Њ –Ј–∞–і–∞—Ф –љ–∞–њ—А—П–Љ–Њ–Ї "–і–љ–Њ —П—А—Г", —Д—Г–љ–Ї—Ж—Ц—П –Љ—Ц–љ—П—Ф—В—М—Б—П –љ–µ–Ј–љ–∞—З–љ–Њ. –Э–∞ –Љ–∞–ї—О–љ–Ї—Г –Ј–Њ–±—А–∞–ґ–µ–љ—Ц –ї—Ц–љ—Ц—Ч —А—Ц–≤–љ—П "—П—А—Г–ґ–љ–Њ—Ч" —Д—Г–љ–Ї—Ж—Ц—Ч —В—А–∞—Ф–Ї—В–Њ—А—Ц—П –≥—А–∞–і—Ц—Ф–љ—В–љ–Њ–≥–Њ –Љ–µ—В–Њ–і—Г —Е–∞—А–∞–Ї—В–µ—А–Є–Ј—Г—Ф—В—М—Б—П –і–Њ—Б–Є—В—М —И–≤–Є–і–Ї–Є–Љ —Б–њ—Г—Б–Ї–Њ–Љ –љ–∞ "–і–љ–Њ —П—А—Г", —Ц –њ–Њ—В—Ц–Љ –њ–Њ–≤—Ц–ї—М–љ–Є–Љ –Ј–Є“С–Ј–∞“С–Њ–њ–Њ–і—Ц–±–љ–Є–Љ —А—Г—Е–Њ–Љ —Г —В–Њ—З–Ї—Г –Љ—Ц–љ—Ц–Љ—Г–Љ—Г.

–Ж—Б–љ—Г—О—В—М —А—Ц–Ј–љ—Ц –њ—Ц–і—Е–Њ–і–Є –і–ї—П –≤–Є–Ј–љ–∞—З–µ–љ–љ—П —В–Њ—З–Ї–Є –Љ—Ц–љ—Ц–Љ—Г–Љ—Г —Д—Г–љ–Ї—Ж—Ц—Ч f (x) —Г —П—А—Г–ґ–љ—Ц–є —Б–Є—В—Г–∞—Ж—Ц—Ч. –С—Ц–ї—М—И—Ц—Б—В—М —Ц–Ј –љ–Є—Е –Ј–∞—Б–љ–Њ–≤–∞–љ—Ц –љ–∞ –µ–≤—А–Є—Б—В–Є—З–љ—Ц (—В–Њ–±—В–Њ —Ц–љ—В—Г—Ч—В–Є–≤–љ–Є—Е, –љ–µ –Њ–±“С—А—Г–љ—В–Њ–≤–∞–љ–Є—Е —Б—В—А–Њ–≥–Њ) –Љ—Ц—А–Ї—Г–≤–∞–љ–љ—П—Е. –З—Е –Љ–Њ–ґ–љ–∞ –Ј–∞—Б—В–Њ—Б–Њ–≤—Г–≤–∞—В–Є –≤ —Б–Є—В—Г–∞—Ж—Ц—П—Е, –Ї–Њ–ї–Є –Ј–∞—Б—В–Њ—Б—Г–≤–∞–љ–љ—П –±—Ц–ї—М—И–µ –Ј—А–Њ–±–ї–µ–љ–Є—Е –Љ–µ—В–Њ–і—Ц–≤ –љ–µ–Љ–Њ–ґ–ї–Є–≤–Њ –∞–±–Њ –љ–µ–і–Њ—Ж—Ц–ї—М–љ–Њ, –љ–∞–њ—А–Є–Ї–ї–∞–і, –Ј–љ–∞—З–µ–љ–љ—П —Ж—Ц–ї—М–Њ–≤–Њ—Ч —Д—Г–љ–Ї—Ж—Ц—Ч –Њ–±—З–Є—Б–ї—О—Ф—В—М—Б—П –Ј—Ц –Ј–љ–∞—З–љ–Є–Љ–Є –њ–Њ–≥—А—Ц—И–љ–Њ—Б—В—П–Љ–Є, —Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—П –њ—А–Њ —Ч—Ч –≤–ї–∞—Б—В–Є–≤–Њ—Б—В—Ц –љ–µ–і–Њ—Б—В–∞—В–љ—П, —Ц —В.–і. –¶—Ц –Љ–µ—В–Њ–і–Є –њ—А–Њ—Б—В—Ц –≤ —А–µ–∞–ї—Ц–Ј–∞—Ж—Ц—Ч –є –і–Њ—Б–Є—В—М —З–∞—Б—В–Њ –Ј–∞—Б—В–Њ—Б–Њ–≤—Г—О—В—М—Б—П –љ–∞ –њ—А–∞–Ї—В–Є—Ж—Ц, –і–Њ–Ј–≤–Њ–ї—П—О—З–Є –≤ —А—П–і—Ц –≤–Є–њ–∞–і–Ї—Ц–≤ –Њ–і–µ—А–ґ–∞—В–Є –Ј–∞–і–Њ–≤—Ц–ї—М–љ–µ —А—Ц—И–µ–љ–љ—П –Ј–∞–і–∞—З—Ц.

–°—Е–µ–Љ–∞ —П—А—Г–ґ–љ–Њ–≥–Њ –Љ–µ—В–Њ–і—Г 1.

–Х–≤—А–Є—Б—В–Є—З–љ—Ц –∞–ї–≥–Њ—А–Є—В–Љ–Є

–Ж–љ–Њ–і—Ц, –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г—О—З–Є –≥—А–∞–і—Ц—Ф–љ—В–љ–Є–є —Б–њ—Г—Б–Ї –і–ї—П –Љ—Ц–љ—Ц–Љ—Ц–Ј–∞—Ж—Ц—Ч —Д—Г–љ–Ї—Ж—Ц–є –Ј—Ц —Б–Ї–ї–∞–і–љ–Њ—О —В–Њ–њ–Њ–≥—А–∞—Д—Ц—З–љ–Њ—О —Б—В—А—Г–Ї—В—Г—А–Њ—О, –Ј–∞—Б—В–Њ—Б–Њ–≤—Г—О—В—М –µ–≤—А–Є—Б—В–Є—З–љ—Ц —Б—Е–µ–Љ–Є, —П–Ї—Ц —Ц–і–µ–є–љ–Њ –±–ї–Є–Ј—М–Ї—Ц –і–Њ –Љ–µ—В–Њ–і—Ц–≤ —Б–њ—Г—Б–Ї–∞. –Ь–Є —А–Њ–Ј–≥–ї—П–љ–µ–Љ–Њ –і–≤—Ц —В–∞–Ї—Ц —Б—Е–µ–Љ–Є.

–Я–µ—А—И–∞ –µ–≤—А–Є—Б—В–Є—З–љ–∞

—Б—Е–µ–Љ–∞ –Љ—Ц—Б—В–Є—В—М –і–≤–∞ –Њ—Б–љ–Њ–≤–љ–Є—Е –µ—В–∞–њ–Є. –Ю–±–Є–і–≤–∞

–µ—В–∞–њ–Є —П–≤–ї—П—О—В—М —Б–Њ–±–Њ—О –∞–љ–∞–ї–Њ–≥–Є –≥—А–∞–і—Ц—Ф–љ—В–љ–Њ–≥–Њ

—Б–њ—Г—Б–Ї–∞ –Ј –њ–Њ—Б—В—Ц–є–љ–Є–Љ –Ї—А–Њ–Ї–Њ–Љ. –Ґ—Ц–ї—М–Ї–Є –Ј–∞–Љ—Ц—Б—В—М

–≥—А–∞–і—Ц—Ф–љ—В–∞

–≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г—Ф—В—М—Б—П –≤–µ–Ї—В–Њ—А g (x), —Д–Њ—А–Љ–Њ–≤–∞–љ–Є–є

–Ј –Ї–Њ–Њ—А–і–Є–љ–∞—В

–≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г—Ф—В—М—Б—П –≤–µ–Ї—В–Њ—А g (x), —Д–Њ—А–Љ–Њ–≤–∞–љ–Є–є

–Ј –Ї–Њ–Њ—А–і–Є–љ–∞—В

,

–∞–ї–µ –љ–∞ –Ї–Њ–ґ–љ–Њ–Љ—Г –Ј –µ—В–∞–њ—Ц–≤ –Ј–∞ —А—Ц–Ј–љ–Є–Љ–Є

–њ—А–∞–≤–Є–ї–∞–Љ–Є.

,

–∞–ї–µ –љ–∞ –Ї–Њ–ґ–љ–Њ–Љ—Г –Ј –µ—В–∞–њ—Ц–≤ –Ј–∞ —А—Ц–Ј–љ–Є–Љ–Є

–њ—А–∞–≤–Є–ї–∞–Љ–Є.

–Э–∞ –њ–µ—А—И–Њ–Љ—Г –µ—В–∞–њ—Ц

–Ј–∞–і–∞—Ф—В—М—Б—П –Љ–∞–ї–µ —З–Є—Б–ї–Њ пБ§>1><<1

—Ц –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г—Ф—В—М—Б—П –≥—А–∞–і—Ц—Ф–љ—В–љ–Є–є —Б–њ—Г—Б–Ї,

–і–µ –Ј–∞–Љ—Ц—Б—В—М –≥—А–∞–і—Ц—Ф–љ—В–∞

–±–µ—А–µ—В—М—Б—П –≤–µ–Ї—В–Њ—А g (x) ={g

(1) (x),вА¶,g

(n) (x) }, —П–Ї–Є–є –≤–Є–Ј–љ–∞—З–∞—Ф—В—М—Б—П

–≤ —В–∞–Ї–Є–є —Б–њ–Њ—Б—Ц–±:

–±–µ—А–µ—В—М—Б—П –≤–µ–Ї—В–Њ—А g (x) ={g

(1) (x),вА¶,g

(n) (x) }, —П–Ї–Є–є –≤–Є–Ј–љ–∞—З–∞—Ф—В—М—Б—П

–≤ —В–∞–Ї–Є–є —Б–њ–Њ—Б—Ц–±:

–Ґ–∞–Ї–Є–Љ —З–Є–љ–Њ–Љ, —Б–њ—Г—Б–Ї –≤–Є—А–Њ–±–ї—П—Ф—В—М—Б—П –ї–Є—И–µ –њ–Њ —В–Є–Љ–Є –Ј–Љ—Ц–љ–љ–Є–Љ, —Г –љ–∞–њ—А—П–Љ–Ї—Г —П–Ї–Є—Е –њ–Њ—Е—Ц–і–љ–∞ —Ж—Ц–ї—М–Њ–≤–Њ—Ч —Д—Г–љ–Ї—Ж—Ц—Ч –і–Њ—Б–Є—В—М –≤–µ–ї–Є–Ї–∞. –¶–µ –і–Њ–Ј–≤–Њ–ї—П—Ф —И–≤–Є–і–Ї–Њ —Б–њ—Г—Б—В–Є—В–Є—Б—П –љ–∞ "–і–љ–Њ —П—А—Г". –Ь–Є —Б–њ—Г—Б–Ї–∞—Ф–Љ–Њ—Б—П –і–Њ—В–Є, –њ–Њ–Ї–Є –Љ–µ—В–Њ–і –љ–µ –Ј–∞—Ж–Є–Ї–ї–Є—В—М—Б—П, —В–Њ–±—В–Њ –і–Њ—В–Є, –њ–Њ–Ї–Є –Ї–Њ–ґ–љ–∞ –љ–∞—Б—В—Г–њ–љ–∞ —Ц—В–µ—А–∞—Ж—Ц—П –і–Њ–Ј–≤–Њ–ї—П—Ф –Ј–љ–∞–є—В–Є —В–Њ—З–Ї—Г, —Г —П–Ї—Ц–є –Ј–љ–∞—З–µ–љ–љ—П —Д—Г–љ–Ї—Ж—Ц—Ч –Љ–µ–љ—И–µ, –љ—Ц–ґ –Ј–љ–∞—З–µ–љ–љ—П, –Ј–љ–∞–є–і–µ–љ–µ –≤ –њ–Њ–њ–µ—А–µ–і–љ—Ц–є —Ц—В–µ—А–∞—Ж—Ц—Ч. –Я—Ц—Б–ї—П —Ж—М–Њ–≥–Њ –њ–µ—А–µ—Е–Њ–і–Є–Љ–Њ –і–Њ –љ–∞—Б—В—Г–њ–љ–Њ–≥–Њ –µ—В–∞–њ—Г.

–Э–∞ –і—А—Г–≥–Њ–Љ—Г –µ—В–∞–њ—Ц

–Ј–∞–і–∞—Ф—В—М—Б—П –і–µ—П–Ї–µ –≤–µ–ї–Є–Ї–µ —З–Є—Б–ї–Њ пБ§>2>>>1

—Ц –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г—Ф—В—М—Б—П –њ—А–Њ—Ж–µ–і—Г—А–∞ —Б–њ—Г—Б–Ї–∞,

–і–µ –Ј–∞–Љ—Ц—Б—В—М –≥—А–∞–і—Ц—Ф–љ—В–∞

–±–µ—А–µ—В—М—Б—П –≤–µ–Ї—В–Њ—А g (x) ={g

(1) (x),вА¶,g

(n) (x) }, —П–Ї–Є–є –≤–Є–Ј–љ–∞—З–∞—Ф—В—М—Б—П

–≤ —В–∞–Ї–Є–є —Б–њ–Њ—Б—Ц–±:

–±–µ—А–µ—В—М—Б—П –≤–µ–Ї—В–Њ—А g (x) ={g

(1) (x),вА¶,g

(n) (x) }, —П–Ї–Є–є –≤–Є–Ј–љ–∞—З–∞—Ф—В—М—Б—П

–≤ —В–∞–Ї–Є–є —Б–њ–Њ—Б—Ц–±:

–£ —Ж—М–Њ–Љ—Г –≤–Є–њ–∞–і–Ї—Г –њ–µ—А–µ–Љ—Ц—Й–µ–љ–љ—П –≤—Ц–і–±—Г–≤–∞—Ф—В—М—Б—П –њ–Њ "–±–µ—А–µ–Ј—Ц" —П—А—Г —Г–Ј–і–Њ–≤–ґ –є–Њ–≥–Њ "–і–љ–∞". –ѓ–Ї —Ц –љ–∞ –њ–µ—А—И–Њ–Љ—Г –µ—В–∞–њ—Ц, —Б–њ—Г—Б–Ї —В—А–Є–≤–∞—Ф –і–Њ—В–Є, –њ–Њ–Ї–Є –Љ–µ—В–Њ–і –љ–µ –Ј–∞—Ж–Є–Ї–ї–Є—В—М—Б—П.

–Я—Ц—Б–ї—П –≤–Є–Ї–Њ–љ–∞–љ–љ—П –њ–µ—А—И–Њ–≥–Њ –є –і—А—Г–≥–Њ–≥–Њ –µ—В–∞–њ—Ц–≤ –њ—А–Є–є–Љ–∞—Ф—В—М—Б—П —А—Ц—И–µ–љ–љ—П –њ—А–Њ –Ј–∞–≤–µ—А—И–µ–љ–љ—П —А–Њ–±–Њ—В–Є –∞–±–Њ –њ—А–Њ–і–Њ–≤–ґ–µ–љ–љ—П. –Ф–ї—П —Ж—М–Њ–≥–Њ —А—Ц–≤–љ—П—Ф—В—М—Б—П –љ–Њ—А–Љ–∞ —А—Ц–Ј–љ–Є—Ж—Ц –њ–Њ–њ–µ—А–µ–і–љ—М–Њ—Ч —В–Њ—З–Ї–Є, —В–Њ–±—В–Њ —В–Њ—З–Ї–Є, —Й–Њ –Љ–Є –Љ–∞–ї–Є –і–Њ –Ј–∞—Б—В–Њ—Б—Г–≤–∞–љ–љ—П –њ–µ—А—И–Њ–≥–Њ –є –і—А—Г–≥–Њ–≥–Њ –µ—В–∞–њ—Ц–≤, –Ј –њ–Њ—В–Њ—З–љ–Њ—О —В–Њ—З–Ї–Њ—О, —В–Њ–±—В–Њ –Њ—В—А–Є–Љ–∞–љ–Њ—Ч –њ—Ц—Б–ї—П –Ј–∞—Б—В–Њ—Б—Г–≤–∞–љ–љ—П –Ј —В–Њ—З–љ—Ц—Б—В—О —А—Ц—И–µ–љ–љ—П –Ј–∞–і–∞—З—Ц пБ•>1>. –ѓ–Ї—Й–Њ —Ж—П –љ–Њ—А–Љ–∞ –Љ–µ–љ—И–µ пБ•>1> —Ц –љ–Њ—А–Љ–∞ –≥—А–∞–і—Ц—Ф–љ—В–∞ –≤ –њ–Њ—В–Њ—З–љ—Ц–є —В–Њ—З—Ж—Ц –Љ–µ–љ—И–µ пБ•>3>, —В–Њ –њ–Њ—И—Г–Ї –Ј–∞–Ї—Ц–љ—З—Г—Ф—В—М—Б—П –є –Њ—Б—В–∞–љ–љ—П –Њ–±—З–Є—Б–ї–µ–љ–∞ —В–Њ—З–Ї–∞ –њ—А–Є–є–Љ–∞—Ф—В—М—Б—П –Ј–∞ –љ–∞–±–ї–Є–ґ–µ–љ–µ —А—Ц—И–µ–љ–љ—П –Ј–∞–і–∞—З—Ц. –Ж–љ–∞–Ї—И–µ –і–ї—П –њ–Њ—В–Њ—З–љ–Њ—Ч —В–Њ—З–Ї–Є –Ј–љ–Њ–≤—Г –њ–Њ–≤—В–Њ—А—О—Ф–Љ–Њ –њ–µ—А—И–Є–є —Ц –і—А—Г–≥–Є–є –µ—В–∞–њ–Є –є —В.–і.

–°—Е–µ–Љ–∞ –∞–ї–≥–Њ—А–Є—В–Љ—Г

–Ъ—А–Њ–Ї 1.

–Ч–∞–і–∞—О—В—М—Б—П —Е>0>, пБ•>1>, пБ•>3>,пБ§>1>,пБ§>2>,пБ°>1> - –њ–Њ—Б—В—Ц–є–љ–Є–є –Ї—А–Њ–Ї –њ—Г–љ–Ї—В—Г 1 —Ц пБ°>2> - –њ–Њ—Б—В—Ц–є–љ–Є–є –Ї—А–Њ–Ї –њ—Г–љ–Ї—В—Г 2 (пБ°>1><пБ°>2>). –Я—А–Є–≤–ї–∞—Б–љ—О—Ф—В—М—Б—П –і–Њ=0.

–Ъ—А–Њ–Ї 2. (–Я–µ—А—И–Є–є –µ—В–∞–њ).

–Ж–Ј —В–Њ—З–Ї–Є —Е>–Ї> –Ј–і—Ц–є—Б–љ—О—Ф—В—М—Б—П —Б–њ—Г—Б–Ї –љ–∞ "–і–љ–Њ —П—А—Г" –Ј –њ–Њ—Б—В—Ц–є–љ–Є–Љ –Ї—А–Њ–Ї–Њ–Љ пБ°>1>.

–Я—А–Є —Б–њ—Г—Б–Ї—Г –Њ–±—З–Є—Б–ї–µ–љ–љ—П —З–µ—А–≥–Њ–≤–Њ—Ч —В–Њ—З–Ї–Є –Ј–і—Ц–є—Б–љ—О—Ф—В—М—Б—П –Ј –≤–Є–Ї–Њ—А–Є—Б—В–∞–љ–љ—П–Љ —Д–Њ—А–Љ—Г–ї:

x>j+1> = x>j> - пБ°>1>g (x>j>), –і–µ g (x) ={g (1) (x),вА¶,g (n) (x) },

–Э –µ—Е–∞–є

—Ж–µ–є –њ—А–Њ—Ж–µ—Б –Ј—Г–њ–Є–љ–Є—В—М—Б—П –≤ —В–Њ—З—Ж—Ц x>l>.

–µ—Е–∞–є

—Ж–µ–є –њ—А–Њ—Ж–µ—Б –Ј—Г–њ–Є–љ–Є—В—М—Б—П –≤ —В–Њ—З—Ж—Ц x>l>.

–Ъ—А–Њ–Ї 3. (–Ф—А—Г–≥–Є–є –µ—В–∞–њ).

–Ж–Ј —В–Њ—З–Ї–Є x>l> –Ј–і—Ц–є—Б–љ—О—Ф—В—М—Б—П —Б–њ—Г—Б–Ї —Г–Ј–і–Њ–≤–ґ "–і–љ–∞ —П—А—Г" –Ј –њ–Њ—Б—В—Ц–є–љ–Є–Љ –Ї—А–Њ–Ї–Њ–Љ пБ°>2>. –Я—А–Є —Б–њ—Г—Б–Ї—Г –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г—О—В—М—Б—П —Д–Њ—А–Љ—Г–ї–Є: x>j+1> = x>j> - пБ°>2>g (x>j>), –і–µ

g (x) ={g (1) (x),вА¶,g (n) (x) },

–Э –µ—Е–∞–є

—Ж–µ–є –њ—А–Њ—Ж–µ—Б –Ј—Г–њ–Є–љ–Є–≤—Б—П –≤ —В–Њ—З—Ж—Ц x>m>.

–µ—Е–∞–є

—Ж–µ–є –њ—А–Њ—Ж–µ—Б –Ј—Г–њ–Є–љ–Є–≤—Б—П –≤ —В–Њ—З—Ж—Ц x>m>.

–Ъ—А–Њ–Ї 4.

–ѓ–Ї—Й–Њ ||x>k>

- x>m>||

пВ£

пБ•>1>

—Ц || || пВ£

пБ•>3>,

—В–Њ –і—Г–Љ–∞—Ф–Љ–Њ:

|| пВ£

пБ•>3>,

—В–Њ –і—Г–Љ–∞—Ф–Љ–Њ:

—Ц –њ–Њ—И—Г–Ї –Љ—Ц–љ—Ц–Љ—Г–Љ—Г –Ј–∞–Ї—Ц–љ—З—Г—Ф—В—М—Б—П.

–Ж–љ–∞–Ї—И–µ k=m —Ц –њ–µ—А–µ—Е–Њ–і–Є–Љ–Њ –і–Њ –Ї—А–Њ–Ї—Г 2.

2. –Ч–∞–≤–і–∞–љ–љ—П –љ–∞ –ї–∞–±–Њ—А–∞—В–Њ—А–љ—Г —А–Њ–±–Њ—В—Г

–Т–Є–≤—З–Є—В–Є –≤–Є–Ї–ї–∞–і–µ–љ—Ц –Љ–µ—В–Њ–і–Є –±–∞–≥–∞—В–Њ–Љ—Ц—А–љ–Њ—Ч –±–µ–Ј—Г–Љ–Њ–≤–љ–Њ—Ч –Њ–њ—В–Є–Љ—Ц–Ј–∞—Ж—Ц—Ч.

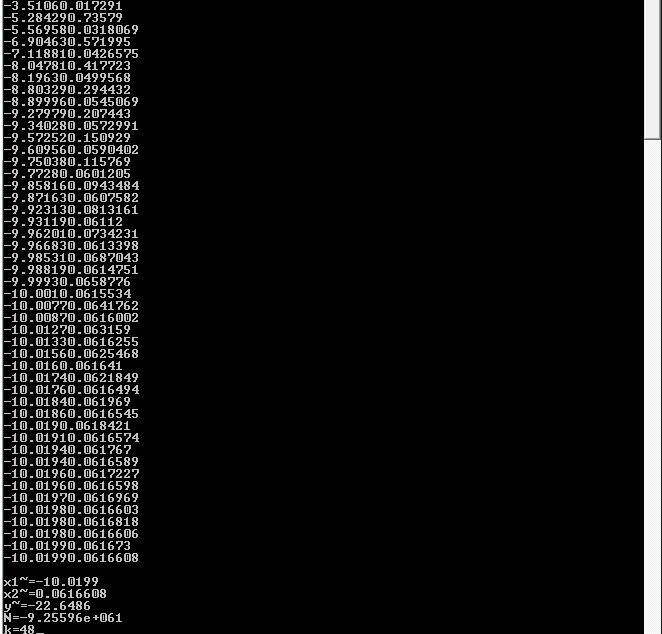

–£ –≤—Ц–і–њ–Њ–≤—Ц–і–љ—Ц—Б—В—М —Ц–Ј –≤–∞—А—Ц–∞–љ—В–Њ–Љ –Ј–∞–≤–і–∞–љ–љ—П, –≤–Ї–∞–Ј–∞–љ–Є–Љ –≤–Є–Ї–ї–∞–і–∞—З–µ–Љ, —Б–Ї–ї–∞—Б—В–Є –њ—А–Њ–≥—А–∞–Љ–Є –і–ї—П –Љ–µ—В–Њ–і—Ц–≤ –±–∞–≥–∞—В–Њ–Љ—Ц—А–љ–Њ—Ч –±–µ–Ј—Г–Љ–Њ–≤–љ–Њ—Ч –Љ—Ц–љ—Ц–Љ—Ц–Ј–∞—Ж—Ц—Ч –є –Ј–љ–∞–є—В–Є —В–Њ—З–Ї—Г –Љ—Ц–љ—Ц–Љ—Г–Љ—Г —Ж—Ц–ї—М–Њ–≤–Њ—Ч —Д—Г–љ–Ї—Ж—Ц—Ч f (x) =f (x (1), x (2)) —Ц–Ј –Ј–∞–і–∞–љ–Њ—О —В–Њ—З–љ—Ц—Б—В—О ќµ –Ј–∞–Ј–љ–∞—З–µ–љ–Є–Љ–Є –Љ–µ—В–Њ–і–∞–Љ–Є. –Я–Њ—З–∞—В–Ї–Њ–≤–µ –љ–∞–±–ї–Є–ґ–µ–љ–љ—П x>0> —Ц —В–Њ—З–љ—Ц—Б—В—М пБ• –њ—А–Є–≤–Њ–і—П—В—М—Б—П –≤ —Г–Љ–Њ–≤—Ц –Ј–∞–і–∞—З—Ц. –Я–Њ—А—Ц–≤–љ—П—В–Є —А–µ–Ј—Г–ї—М—В–∞—В–Є, –Њ—В—А–Є–Љ–∞–љ—Ц —А—Ц–Ј–љ–Є–Љ–Є –Љ–µ—В–Њ–і–∞–Љ–Є –і–ї—П –Њ–і–љ—Ц—Ф—Ч –є —В—Ц—Ф—Ч –ґ —Ж—Ц–ї—М–Њ–≤–Њ—Ч —Д—Г–љ–Ї—Ж—Ц—Ч (–Ј–Њ–Ї—А–µ–Љ–∞, –њ–Њ—А—Ц–≤–љ—П—В–Є —З–Є—Б–ї–Њ –Њ–±—З–Є—Б–ї–µ–љ—М —Ж—Ц–ї—М–Њ–≤–Њ—Ч —Д—Г–љ–Ї—Ж—Ц—Ч —Ц —Ч—Ч –њ–Њ—Е—Ц–і–љ–Є—Е, —Й–Њ –Ј–љ–∞–і–Њ–±–Є–ї–Є—Б—П –і–ї—П –Њ–і–µ—А–ґ–∞–љ–љ—П –Ј–∞–і–∞–љ–Њ—Ч —В–Њ—З–љ–Њ—Б—В—Ц). –Ф–ї—П –Ї–Њ–ґ–љ–Њ–≥–Њ –≤–Є–Ї–Њ—А–Є—Б—В–∞–љ–Њ–≥–Њ –Љ–µ—В–Њ–і—Г –њ–Њ–±—Г–і—Г–≤–∞—В–Є —В—А–∞—Ф–Ї—В–Њ—А—Ц—О –њ—А–Њ–Љ—Ц–ґ–љ–Є—Е —В–Њ—З–Њ–Ї, —П–Ї—Ц –Њ–і–µ—А–ґ–∞–љ—Ц –љ–∞ —З–µ—А–≥–Њ–≤–Є—Е –Ї—А–Њ–Ї–∞—Е –Љ–µ—В–Њ–і—Г –є –Ј–±—Ц–ґ–љ–Є—Е –і–Њ —В–Њ—З–Ї–Є –Љ—Ц–љ—Ц–Љ—Г–Љ—Г.

–Ю—Д–Њ—А–Љ–Є—В–Є –Ј–≤—Ц—В –њ—А–Њ –≤–Є–Ї–Њ–љ–∞–љ–љ—П –Ј–∞–≤–і–∞–љ–љ—П —Ц–Ј –њ—А–Є–≤–µ–і–µ–љ–љ—П–Љ —Г–Љ–Њ–≤–Є –Ј–∞–і–∞—З—Ц, –∞–ї–≥–Њ—А–Є—В–Љ—Ц–≤ —Ц –њ—А–Њ–≥—А–∞–Љ, –Ј–∞–Ј–љ–∞—З–µ–љ–Є—Е —Г –Ј–∞–≤–і–∞–љ–љ—Ц –Љ–µ—В–Њ–і—Ц–≤ –Љ—Ц–љ—Ц–Љ—Ц–Ј–∞—Ж—Ц—Ч, –≥—А–∞—Д—Ц–Ї—Ц–≤ —В—А–∞—Ф–Ї—В–Њ—А—Ц–є –њ—А–Њ–Љ—Ц–ґ–љ–Є—Е –љ–∞–±–ї–Є–ґ–µ–љ—М, —В–∞–±–ї–Є—Ж—Ц —А–µ–Ј—Г–ї—М—В–∞—В—Ц–≤ –њ–Њ—А—Ц–≤–љ—П–љ–љ—П —А–Њ–Ј–≥–ї—П–љ—Г—В–Є—Е –Љ–µ—В–Њ–і—Ц–≤, –≤–Є—Б–љ–Њ–≤–Ї—Г –Ј–∞ —А–µ–Ј—Г–ї—М—В–∞—В–∞–Љ–Є –њ–Њ—А—Ц–≤–љ—П–љ–љ—П –Љ–µ—В–Њ–і—Ц–≤.

–Ь–µ—В–Њ–і–Є

–Љ–µ—В–Њ–і –љ–∞–є—И–≤–Є–і—И–Њ–≥–Њ —Б–њ—Г—Б–Ї—Г;

–µ–≤—А–Є—Б—В–Є—З–љ–Є–є –∞–ї–≥–Њ—А–Є—В–Љ;

–Т–∞—А—Ц–∞–љ—В–Є –Ј–∞–≤–і–∞–љ—М

–¶—Ц–ї—М–Њ–≤–∞ —Д—Г–љ–Ї—Ж—Ц—П f (x) =f (x (1), x (2)) –Ј–∞–ї–µ–ґ–Є—В—М –≤—Ц–і –і–≤–Њ—Е –∞—А–≥—Г–Љ–µ–љ—В—Ц–≤. –§—Г–љ–Ї—Ж—Ц—П f (x) –љ–∞—Б—В—Г–њ–љ–Њ–≥–Њ –≤–Є–і—Г:

f (x) =a*x (1) +b*x (2) +ec* (x) +d* (x).

|

вДЦ –≤–∞—А |

вДЦ –Љ–µ—В–Њ–і—Г |

–¶—Ц–ї—М–Њ–≤–∞ —Д—Г–љ–Ї—Ж—Ц—П |

–Я–Њ—З–∞—В–Ї–Њ–≤–µ –љ–∞–±–ї–Є–ґ–µ–љ–љ—П |

–Ґ–Њ—З–љ—Ц—Б—В—М —А–Њ–Ј–≤вАЩ—П–Ј–Ї—Г |

|||

|

a |

b |

c |

d |

||||

|

6 |

3, 6 |

3 |

-1,2 |

0,02 |

1,3 |

(-1; 0) |

0,0001 |

–Я—А–Њ–≥—А–∞–Љ–∞ –і–Њ –Љ–µ—В–Њ–і—Г вДЦ 1

#include <stdio.h>

#include <math.h>

#include <iostream.h>

#include <conio.h>

// ing namespace std;

double f (double x1, double x2)

{ double f;

f=3*x1-1.2*x2+exp (0.02*x1*x1+1.3*x2*x2);

return (f);

}

double df1 (double x1, double x2)

{double f1;

f1=3+0.04*x1*exp (0.02*x1*x1+1.3*x2*x2);

return (f1);

}

double df2 (double x1, double x2)

{double f2;

f2=-1.2+2.6*x2*exp (0.02*x1*x1+1.3*x2*x2);

return (f2);

}

double zsech (double a,double b,double x1k,double x2k,double z1,double z2)

{

double eps=0.0001;

double x1,x2,y1,y2,t;

t= (1+sqrt (5)) /2;

x1=a- (b-a) / (t);

y1=f (x1k-x1*z1,x2k-x1*z2);

x2=a+ (b-a) /t;

y2=f (x1k-x2*z1,x2k-x2*z2);

while ( (b-a) >eps) {

if (y1<=y2) { b=x2; x2=x1; y2=y1; x1=a+b-x2; y1=f (x1k-x1*z1,x2k-x1*z2); }

else { a=x1; x1=x2; y1=y2; x2=a+b-x1; y2=f (x1k-x2*z1,x2k-x2*z2); }

}

// if (y1<y2) b=x2;

// else a=x1;

return ( (a+b) /2);

}

void main ()

{int k, i,N,N0,N1,l1,l2;

double a,b,d,ymin,xmin1,xmin2,e2,dalph;

double x [3000] [2]; double y [10];

clrscr ();

x [0] [1] =-1;

x [0] [2] =0;

e2=0.0001;

double z1,z2,y1,y2,e,p,alpmin,g1,g2;

int m;

cout<<"Metod naiskor. spuska"<<endl;

k=0; N0=0; N1=0;

z1=df1 (x [0] [1],x [0] [2]);

z2=df2 (x [0] [1],x [0] [2]);

N1=N1+2;

dalph=2.2;

mm1:

m = 0;

y1=f (x [k] [1],x [k] [2]); N0++;

metka:

y2=f (x [k] [1] - (m+1) *dalph*z1,x [k] [2] - (m+1) *dalph*z2);

N0++;

if (y2<y1)

{m++; y1=y2; goto metka; }

else

{b= (m+1) *dalph;

if (m==0)

{a=0; }

else {a= (m-1) *dalph; }

}

alpmin=zsech (a,b,x [k] [1],x [k] [2],z1,z2);

cout<<"\nk="<<k+1<<endl;

x [k+1] [1] =x [k] [1] - alpmin*z1; cout<<"\nx [1] [1] ="<<x [k+1] [1];

x [k+1] [2] =x [k] [2] - alpmin*z2; cout<<"\nx [1] [2] ="<<x [k+1] [2] <<endl; // getch ();

z1=df1 (x [k+1] [1],x [k+1] [2]);

z2=df2 (x [k+1] [1],x [k+1] [2]);

N1=N1+2;

d=pow (z1*z1+z2*z2,0.5);

if (d>e2)

{k++; goto mm1; }

else {xmin1=x [k+1] [1];

xmin2=x [k+1] [2];

ymin=f (xmin1,xmin2);

cout<<"x1="<<xmin1<<" x2="<<xmin2<<" ymin="<<ymin<<endl<<"N1="<<N1;

cout<<" N0="<<N0<<" k="<<k+1<<endl;

}

// return 0;

getch ();

}

–Ь–µ—В–Њ–і 2

include "iostream"

#include <math.h>

#include <conio.h>

#include <stdlib.h>

#include "iomanip"

#include <stdio.h>

using namespace std;

int N0=0, N1=0;

double a=3, b=-1.2, c=0.02, d=1.3;

double f (double x1, double x2)

{

double f;

N0++;

f=3*x1-1.2*x2+exp (0.02*x1*x1+1.3*x2*x2);

return (f);

}

double fdx1 (double x1,double x2)

{double fx1;

N1++;

fx1=3+0.04*x1*exp (0.02*x1*x1+1.3*x2*x2);

return (fx1); }

double fdx2 (double x1,double x2)

{ double fx2;

N1++;

fx2=-1.2+2.6*x2*exp (0.02*x1*x1+1.3*x2*x2);

return (fx2); }

void evrist ()

{ double x1 [100],x2 [100],A1,A2,E2,del1,del2,f1,f2,h [4],g [4],b [4],r [4];

double d,N;

int k;

x1 [0] =-1;

x2 [0] =0;

E2=0.0001;

del1=0.01;

del2=3;

A1=0.5;

A2=2;

k=0;

label1:

do{

h [1] =fdx1 (x1 [k],x2 [k]);

if (fabs (h [1]) >del1) {g [1] =h [1]; }

else {g [1] =0; }

h [2] =fdx2 (x1 [k],x2 [k]);

if (fabs (h [2]) >del1) {g [2] =h [2]; }

else {g [2] =0; }

x1 [k+1] =x1 [k] - A1*g [1];

x2 [k+1] =x2 [k] - A1*g [2];

// cout<<":: "<<x1 [k] <<":: "<<x2 [k] <<endl;

f1=f (x1 [k+1],x2 [k+1]);

f2=f (x1 [k],x2 [k]);

k++;

}

while (f1<f2);

k--;

do{

r [1] =fdx1 (x1 [k],x2 [k]);

if (fabs (r [1]) >del2) {b [1] =0; }

else {b [1] =r [1]; }

r [2] =fdx2 (x1 [k],x2 [k]);

if (fabs (r [2]) >del2) {b [2] =0; }

else {b [2] =r [2]; }

x1 [k+1] =x1 [k] - A2*b [1];

x2 [k+1] =x2 [k] - A2*b [2];

cout<<x1 [k+1] <<":: "<<x2 [k+1] <<endl;

f1=f (x1 [k+1],x2 [k+1]);

f2=f (x1 [k],x2 [k]);

k++;

}while (f1<f2);

k--;

d=pow (r [1],2) +pow (r [2],2);

if (sqrt (d) >E2) {A1=A1/2.0; A2=A2/2.0; goto label1; }

else {cout<<"X1="<<x1 [k] <<" X2="<<x2 [k] <<" F (x) ="<<f (x1 [k],x2 [k]) <<endl;

N=N1+N0;

cout<<"–Ъ–Њ–ї-–≤–Њ —Н–Ї—Б–њ–µ—А.: "<<N<<" –Ъ–Њ–ї-–≤–Њ –Є—В–µ—А–∞—Ж–Є–є: "<<k<<":: "<<N0<<endl; }

N0=0; N1=0;

}

void main ()

{

evrist ();

getch ();

}

–°–Ї—А–Є–љ –і–Њ –Љ–µ—В–Њ–і—Г 1

пїњ