Вычислительная математика

Содержание

Введение

Тема 1. Решение задач вычислительными методами. Основные понятия

1.1 Погрешность

1.2 Корректность

1.3 Вычислительные методы

Тема 2. Решение нелинейных уравнений

2.1 Постановка задачи

2.2 Основные этапы отыскания решения

2.3 Метод деления отрезка пополам (метод дихотомии, метод бисекции)

2.4 Метод простых итераций

2.5 Метод Ньютона (метод касательных)

2.6 Метод секущих (метод хорд)

2.7 Метод ложного положения

Тема 3. Решение систем линейных алгебраических уравнений

3.1 Постановка задачи

3.2 Метод исключения Гаусса. Схема единственного деления

3.3 Метод исключения Гаусса с выбором главного элемента по столбцу

3.4 Вычисление определителя методом исключения Гаусса

3.5 Вычисление обратной матрицы методом исключения Гаусса

3.6 Метод простой итерации Якоби

3.7 Метод Зейделя

Тема 4. Приближение функций

4.1 Постановка задачи

4.2 Приближение функции многочленами Тейлора

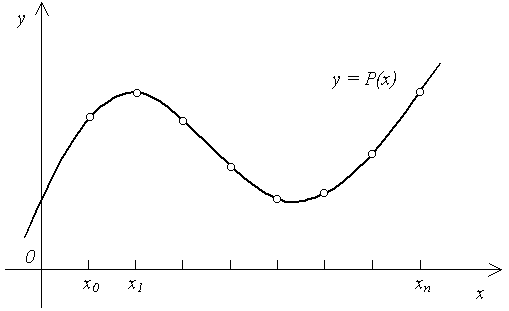

4.3 Интерполяция функции многочленами Лагранжа

4.4 Аппроксимация функций. Метод наименьших квадратов

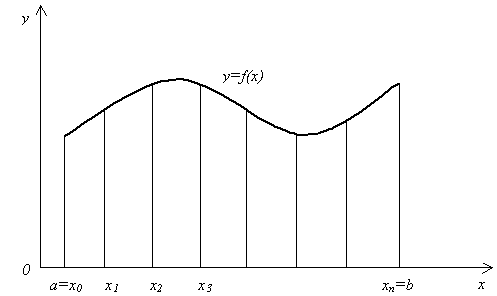

Тема 5. Численное интегрирование функций одной переменной

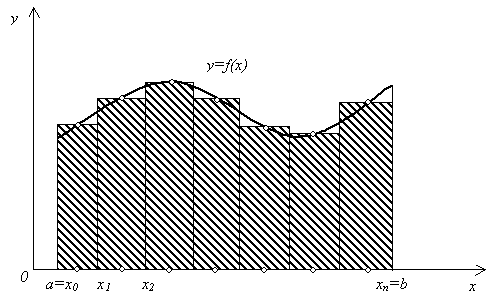

5.1 Постановка задачи численного интегрирования

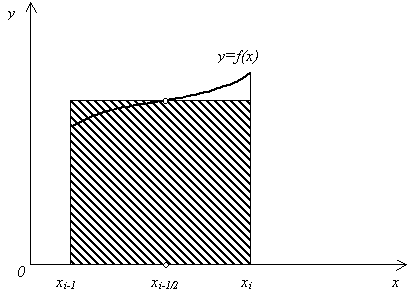

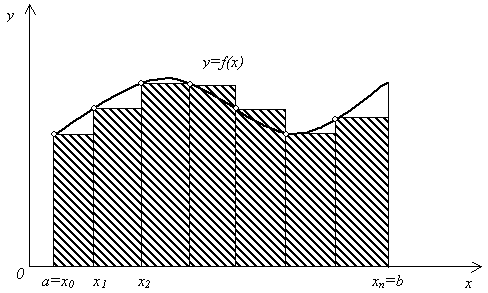

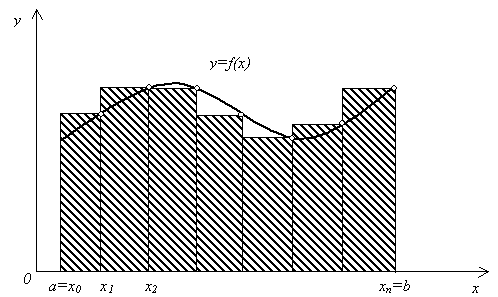

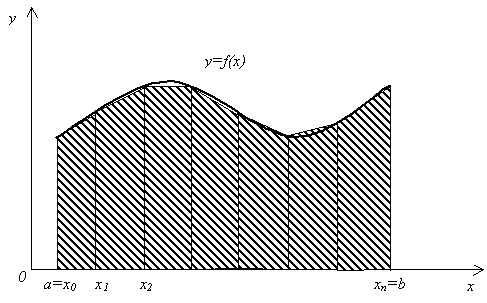

5.2 Метод средних прямоугольников

5.3 Метод трапеций

5.4 Метод Симпсона (метод парабол)

5.5 Правило Рунге практической оценки погрешности

Тема 6. Численное решение дифференциальных уравнений

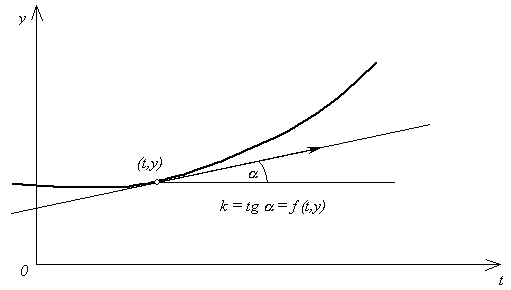

6.1 Постановка задачи Коши

6.2 Метод Эйлера

6.3 Модифицированные методы Эйлера

6.4 Метод Рунге – Кутты

Контрольные задания по курсу “Вычислительные методы”

Указания к выполнению лабораторных работ

Указания к выполнению курсовых работ

Краткие сведения о математиках

Список литературы

Введение

Исследование различных явлений или процессов математическими методами осуществляется с помощью математической модели. Математическая модель представляет собой формализованное описание на языке математики исследуемого объекта. Таким формализованным описанием может быть система линейных, нелинейных или дифференциальных уравнений, система неравенств, определенный интеграл, многочлен с неизвестными коэффициентами и т. д. Математическая модель должна охватывать важнейшие характеристики исследуемого объекта и отражать связи между ними.

После того, как математическая модель составлена, переходят к постановке вычислительной задачи. При этом устанавливают, какие характеристики математической модели являются исходными (входными) данными, какие – параметрами модели, а какие – выходными данными. Проводится анализ полученной задачи с точки зрения существования и единственности решения.

На следующем этапе выбирается метод решения задачи. Во многих конкретных случаях найти решение задачи в явном виде не представляется возможным, так как оно не выражается через элементарные функции. Такие задачи можно решить лишь приближенно. Под вычислительными (численными) методами подразумеваются приближенные процедуры, позволяющие получать решение в виде конкретных числовых значений. Вычислительные методы, как правило, реализуются на ЭВМ. Для решения одной и той же задачи могут быть использованы различные вычислительные методы, поэтому нужно уметь оценивать качество различных методов и эффективность их применения для данной задачи.

Затем для реализации выбранного вычислительного метода составляется алгоритм и программа для ЭВМ. Современному инженеру важно уметь преобразовать задачу к виду, удобному для реализации на ЭВМ и построить алгоритм решения такой задачи.

В настоящее время на рынке программного обеспечения широко представлены как пакеты, реализующие наиболее общие методы решения широкого круга задач (например, Maple, Mathcad, MatLAB), так и пакеты, реализующие методы решения специальных задач (например, задач газовой динамики).

Результаты расчета анализируются и интерпретируются. При необходимости корректируются параметры метода, а иногда математическая модель, и начинается новый цикл решения задачи.

Тема 1. Решение задач вычислительными методами.

Основные понятия

1.1 Погрешность

Существуют четыре источника погрешностей, возникающих в результате численного решения задачи.

1. Математическая модель. Погрешность математической модели связана с ее приближенным описанием реального объекта. Например, если при моделировании экономической системы не учитывать инфляции, а считать цены постоянными, трудно рассчитывать на достоверность результатов. Погрешность математической модели называется неустранимой. Будем в дальнейшем предполагать, что математическая модель фиксирована и ее погрешность учитывать не будем.

2. Исходные данные. Исходные данные, как правило, содержат погрешности, так как они либо неточно измерены, либо являются результатом решения некоторых вспомогательных задач. Например, масса снаряда, производительность оборудования, предполагаемая цена товара и др. Во многих физических и технических задачах погрешность измерений составляет 1 – 10%. Погрешность исходных данных так же, как и погрешность математической модели, считается неустранимой и в дальнейшем учитываться не будет.

3. Метод вычислений. Применяемые для решения задачи методы как правило являются приближенными. Например, заменяют интеграл суммой, функцию – многочленом, производную – разностью и т. д. Погрешность метода необходимо определять для конкретного метода. Обычно ее можно оценить и проконтролировать. Следует выбирать погрешность метода так, чтобы она была не более, чем на порядок меньше неустранимой погрешности. Большая погрешность снижает точность решения, а меньшая требует значительного увеличения объема вычислений.

4. Округление в вычислениях. Погрешность округления возникает из-за того, что вычисления производятся с конечным числом значащих цифр (для ЭВМ это 10 – 12 знаков). Округление производят по следующему правилу: если в старшем из отбрасываемых разрядов стоит цифра меньше пяти, то содержимое сохраняемых разрядов не изменяется; в противном случае в младший сохраняемый разряд добавляется единица с тем же знаком, что и у самого числа. При решении больших задач производятся миллиарды вычислений, но так как погрешности имеют разные знаки, то они частично взаимокомпенсируются.

Различают абсолютную и относительную погрешности. Пусть а – точное, вообще говоря неизвестное числовое значение некоторой величины, а а* - известное приближенное значение этой величины, тогда величину

(а*) = | а – а*|

называют

абсолютной погрешностью числа

а*, а

величину

(а*)

=

– его относительной погрешностью.

При сложении и вычитании складываются абсолютные погрешности, а при делении и умножении – относительные погрешности.

1.2 Корректность

Определим вначале понятие устойчивости решения.

Решение задачи y* называется устойчивым по исходным данным x*, если оно зависит от исходных данных непрерывным образом. Это означает, что малому изменению исходных данных соответствует малое изменение решения. Строго говоря, для любого > 0 существует = () > 0 такое, что всякому исходному данному x*, удовлетворяющему условию |x - x*| < , соответствует приближенное решение y*, для которого |y – y*| < .

Говорят, что задача поставлена корректно, если выполнены следующие три условия:

1. Решение существует при любых допустимых исходных данных.

2. Это решение единственно.

3. Это решение устойчиво по отношению к малым изменениям исходных данных.

Если хотя бы одно из этих условий не выполнено, задача называется некорректной.

Пример 1.1.

Покажем,

что задача вычисления определенного

интеграла I

=

корректна.

Пусть f*(x)

– приближенно заданная функция и I*

=

корректна.

Пусть f*(x)

– приближенно заданная функция и I*

=

.

Очевидно, приближенное решение I*

существует и единственно.

Определим абсолютную погрешность f*

с помощью равенства (f*)

=

.

Очевидно, приближенное решение I*

существует и единственно.

Определим абсолютную погрешность f*

с помощью равенства (f*)

=

|f(x)

– f*(x)|.

Так как

|f(x)

– f*(x)|.

Так как

(I)

= |I – I*|

= | |

(b – a)(f*),

|

(b – a)(f*),

то для любого > 0 неравенство (I) < будет выполнено, если будет выполнено условие (f*) < , где = /(b – a).

Таким образом, решение I* устойчиво. Все три условия корректности задачи выполнены.

Пример 1.2.

Покажем, что задача вычисления производной u(x) = f '(x) приближенно заданной функции некорректна.

Пусть

f*(x)

– приближенно заданная на отрезке [a,

b] непрерывно

дифференцируемая функция и u*(x)

= (f*(x))'.

Определим абсолютные погрешности

следующим образом: (f*)

=

|f(x)

– f*(x)|,

(u*)

=

|f(x)

– f*(x)|,

(u*)

=

|u(x)

– u*(x)|.

|u(x)

– u*(x)|.

Возьмем, например, f*(x) = f(x) + sin(x/2), где 0 < < 1. Тогда, u*(x) = u(x) + -1cos(x/2), (u*) = -1, т. е. погрешность задания функции равна , а погрешность производной равна -1. Таким образом, сколь угодно малой погрешности задания функции f может отвечать сколь угодно большая погрешность производной f '.

1.3 Вычислительные методы

Под вычислительными методами будем понимать методы, которые используются в вычислительной математике для преобразования задач к виду, удобному для реализации на ЭВМ. Подробнее с различными классами вычислительных методов можно познакомиться, например, в [1]. Мы же рассмотрим два класса методов, используемых в нашем курсе.

1. Прямые методы. Метод решения задачи называется прямым, если он позволяет получить решение после выполнения конечного числа элементарных операций. Наименование элементарной операции здесь условно. Это может быть, например, вычисление интеграла, решение системы уравнений, вычисление значений функции и т. д. Важно то, что ее сложность существенно меньше, чем сложность основной задачи. Иногда прямые методы называют точными, имея в виду, что при отсутствии ошибок в исходных данных и при выполнении элементарных операций результат будет точным. Однако, при реализации метода на ЭВМ неизбежны ошибки округления и, как следствие, наличие вычислительной погрешности.

2. Итерационные методы. Суть итерационных методов состоит в построении последовательных приближений к решению задачи. Вначале выбирают одно или несколько начальных приближений, а затем последовательно, используя найденные ранее приближения и однотипную процедуру расчета, строят новые приближения. В результате такого итерационного процесса можно теоретически построить бесконечную последовательность приближений к решению. Если эта последовательность сходится (что бывает не всегда), то говорят, что итерационный метод сходится. Отдельный шаг итерационного процесса называется итерацией.

Практически вычисления не могут продолжаться бесконечно долго. Поэтому необходимо выбрать критерий окончания итерационного процесса. Критерий окончания связан с требуемой точностью вычислений, а именно: вычисления заканчиваются, когда погрешность приближения не превышает заданной величины.

Оценки погрешности приближения, полученные до вычислений, называют априорными оценками (от лат. a'priori – "до опыта"), а соответствующие оценки, полученные в ходе вычислений называют апостериорными оценками (от лат. a'posteriori – "после опыта").

Важной характеристикой итерационных методов является скорость сходимости метода. Говорят, что метод имеет p-ый порядок сходимости если

|x>n+1> - x*| = C|x>n> - x*|p,

где x>n> и x>n+1> – последовательные приближения, полученные в ходе итерационного процесса вычислений, x* – точное решение, C – константа, не зависящая от n. Говорят, что метод сходится со скоростью геометрической прогрессии со знаменателем q < 1, если для всех n справедлива оценка:

|x>n> - x*| Cqn.

Итерационный процесс называется одношаговым, если для вычисления очередного приближения x>n+1> используется только одно предыдущее приближение x>n> и k –шаговым, если для вычисления x>n+1> используются k предыдущих приближений x>n-k+1>, x>n-k+2>, …, x>n>.

Тема 2. Решение нелинейных уравнений

2.1 Постановка задачи

Пусть дана некоторая функция f(x) и требуется найти все или некоторые значения x, для которых

f(x) = 0. (2.1)

Значение x*, при котором f(x*) = 0, называется корнем (или решением) уравнения (2.1).

Относительно функции f(x) часто предполагается, что f(x) дважды непрерывно дифференцируема в окрестности корня.

Корень

x*

уравнения (2.1) называется простым,

если первая производная функции f(x)

в точке x*

не равна нулю, т. е. f '(x*)

0. Если же f '(x*)

= 0, то корень x*

называется кратным

корнем.

0. Если же f '(x*)

= 0, то корень x*

называется кратным

корнем.

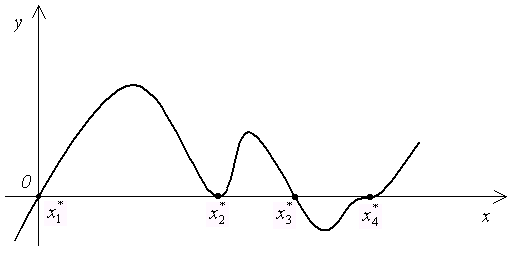

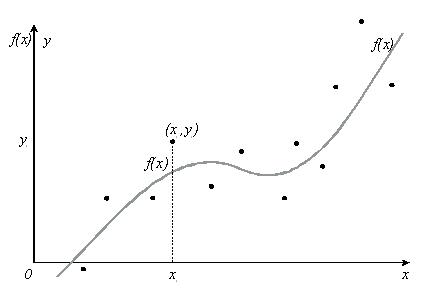

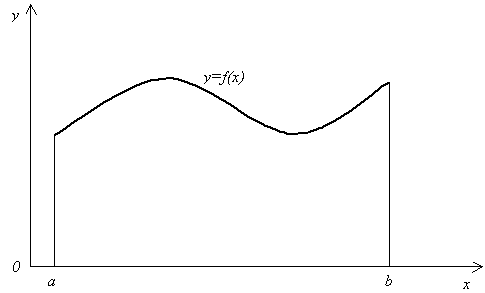

Геометрически

корень уравнения (2.1) есть точка пересечения

графика функции y

= f(x)

с осью абсцисс. На рис. 2.1 изображен

график функции y

= f(x),

имеющей четыре корня: два простых (x и

x

и

x )

и два кратных (x

)

и два кратных (x и

x

и

x ).

).

Рис. 2.1.

Большинство методов решения уравнения (2.1) ориентировано на отыскание простых корней уравнения (2.1).

2.2 Основные этапы отыскания решения

В процессе приближенного отыскания корней уравнения (2.1) обычно выделяют два этапа: локализация (или отделение) корня и уточнение корня.

Локализация корня заключается в определении отрезка [a, b], содержащего один и только один корень. Не существует универсального алгоритма локализации корня. В некоторых случаях отрезок локализации может быть найден из физических соображений. Иногда удобно бывает локализовать корень с помощью построения графика или таблицы значений функции y = f(x). На наличие корня на отрезке [a, b] указывает различие знаков функции на концах отрезка. Основанием для этого служит следующая теорема математического анализа.

Теорема 2.1. Если функция f непрерывна на отрезке [a, b] и принимает на его концах значения разных знаков, так, что f(a)f(b) < 0, то отрезок [a, b] содержит по крайней мере один корень уравнения f(x) = 0.

Однако, корень четной кратности таким образом локализовать нельзя, так как в окрестности такого корня функция f(x) имеет постоянный знак.

На этапе уточнения корня вычисляют приближенное значение корня с заданной точностью > 0. Приближенное значение корня уточняют с помощью различных итерационных методов. Суть этих методов состоит в последовательном вычислении значений x>0>, x>1>, …, x>n>, …, которые являются приближениями к корню x*.

2.3 Метод деления отрезка пополам (метод дихотомии, метод бисекции)

Метод деления отрезка пополам является самым простым и надежным способом решения нелинейного уравнения.

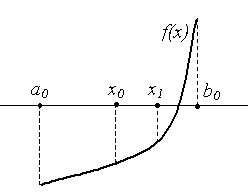

Пусть

из предварительного анализа известно,

что корень уравнения (2.1) находится на

отрезке [a>0>,

b>0>],

т. е. x* [a>0>,

b>0>],

так, что f(x*)

= 0.

[a>0>,

b>0>],

так, что f(x*)

= 0.

Пусть функция f(x) непрерывна на отрезке [a>0>, b>0>] и принимает на концах отрезка значения разных знаков, т.е.

f(a>0>)f(b>0>) < 0. (2.2)

Разделим

отрезок [a>0>,

b>0>]

пополам. Получим точку x>0

>=

.

Вычислим значение функции в этой точке:

f(x>0>).

Если f(x>0>)

= 0, то x>0 >–

искомый корень, и задача решена. Если

f(x>0>)

.

Вычислим значение функции в этой точке:

f(x>0>).

Если f(x>0>)

= 0, то x>0 >–

искомый корень, и задача решена. Если

f(x>0>) 0,

то f(x>0>)

– число определенного знака: f(x>0>)

> 0, либо f(x>0>)

< 0. Тогда либо на концах отрезка [a>0>,

x>0>],

либо на концах отрезка [x>0>,

b>0>]

значения функции f(x)

имеют разные знаки. Обозначим такой

отрезок [a>1>,

b>1>].

Очевидно, что x*

0,

то f(x>0>)

– число определенного знака: f(x>0>)

> 0, либо f(x>0>)

< 0. Тогда либо на концах отрезка [a>0>,

x>0>],

либо на концах отрезка [x>0>,

b>0>]

значения функции f(x)

имеют разные знаки. Обозначим такой

отрезок [a>1>,

b>1>].

Очевидно, что x* [a>1>,

b>1>],

и длина отрезка [a>1>,

b>1>]

в два раза меньше, чем длина отрезка

[a>0>,

b>0>].

Поступим аналогично с отрезком [a>1>,

b>1>].

В результате получим либо корень x*,

либо новый отрезок [a>2>,

b>2>],

и т.д. (рис. 2.2).

[a>1>,

b>1>],

и длина отрезка [a>1>,

b>1>]

в два раза меньше, чем длина отрезка

[a>0>,

b>0>].

Поступим аналогично с отрезком [a>1>,

b>1>].

В результате получим либо корень x*,

либо новый отрезок [a>2>,

b>2>],

и т.д. (рис. 2.2).

Рис. 2.2

Середина

n-го отрезка x>n

>=

.

Очевидно, что длина отрезка [a>n>,

b>n>]

будет равна

.

Очевидно, что длина отрезка [a>n>,

b>n>]

будет равна

,

а т. к. x*

,

а т. к. x* [a>n>,

b>n>],

то

[a>n>,

b>n>],

то

| x>n>

– x*|

.

(2.3)

.

(2.3)

Погрешность метода. Оценка (2.3) характеризует погрешность метода деления отрезка пополам и указывает на скорость сходимости: метод сходится со скоростью геометрической прогрессии, знаменатель которой q = 1/2. Заметим, что оценка (2.3) является априорной.

Критерий окончания. Из соотношения (2.3) следует, что при заданной точности приближения вычисления заканчиваются, когда будет выполнено неравенство b>n> – a>n> < 2 или неравенство n > log>2>((b>0> – a>0>)/) – 1. Таким образом, количество итераций можно определить заранее. За приближенное значение корня берется величина x>n>.

Пример 2.1.

Найдем

приближенно x

=

с точностью = 0.01. Эта задача эквивалентна

решению уравнения x5

– 2 = 0, или нахождению нуля

функции f(x)

= x5 –

2. В качестве начального отрезка [a>0>,

b>0>]

возьмем отрезок [1, 2]. На концах этого

отрезка функция принимает значения с

разными знаками: f(1)

< 0, f(2) > 0.

с точностью = 0.01. Эта задача эквивалентна

решению уравнения x5

– 2 = 0, или нахождению нуля

функции f(x)

= x5 –

2. В качестве начального отрезка [a>0>,

b>0>]

возьмем отрезок [1, 2]. На концах этого

отрезка функция принимает значения с

разными знаками: f(1)

< 0, f(2) > 0.

Найдем число n делений отрезка [1, 2], необходимых для достижения требуемой точности. Имеем:

| x>n>

– x*|

=

=

10-2,

10-2,

n 6.

6.

Следовательно,

не позднее 6-го деления найдем

с требуемой точностью,

с требуемой точностью,

1.1484. Результаты вычислений представлены

в таблице 2.1.

1.1484. Результаты вычислений представлены

в таблице 2.1.

Таблица 2.1

-

n

0 1 2 3 4 5 6

a>n>

1.0000 1.0000 1.0000 1.1250 1.1250 1.1406 1.1406

b>n>

2.0000 1.5000 1.2500 1.2500 1.1875 1.1875 1.1562

x>n>

1.5000 1.2500 1.1250 1.1875 1.1406 1.1562 1.1484

Зн f(a>n>)

- - - - - - -

Зн f(b>n>)

+ + + + + + +

f(x>n>)

5.5938 0.7585 -0.2959 0.1812 -0.0691 0.0532 -0.0078

b>n> – a>n>

1.0000 0.5000 0. 2500 0.1250 0.0625 0.0312 0.0156

2.4 Метод простых итераций

Пусть уравнение (2.1) можно заменить эквивалентным ему уравнением

x = (x). (2.4)

Например,

уравнение

– 0.5 = 0 можно заменить эквивалентным

ему уравнением x

= 0.5sinx.

– 0.5 = 0 можно заменить эквивалентным

ему уравнением x

= 0.5sinx.

Выберем каким-либо образом начальное приближение x>0>. Вычислим значение функции (x) при x = x>0> и найдем уточненное значение x>1> = (x>0>). Подставим теперь x>1 >в уравнение (2.4) и получим новое приближение x>2> = (x>1>) и т. д. Продолжая этот процесс неограниченно, получим последовательность приближений к корню:

x>n+1> = (x>n>). (2.5)

Формула (2.5) является расчетной формулой метода простых итераций.

Если

последовательность {x>n>}

сходится при n ,

т. е. существует

,

т. е. существует

x*

=

x>n> ,

(2.6)

x>n> ,

(2.6)

и функция (x) непрерывна, то, переходя к пределу в (2.5) и учитывая (2.6), получим:

x*

=

x>n>

=

x>n>

=

(x

>n>>

->>1>)

= (

(x

>n>>

->>1>)

= ( x>n>>

->>1>)

= (x*).

x>n>>

->>1>)

= (x*).

Таким образом, x* = (x*), следовательно, x* – корень уравнения (2.4).

Сходимость метода. Сходимость метода простых итераций устанавливает следующая теорема.

Теорема 2.2. Если в интервале, содержащем корень x* уравнения (2.4), а также его последовательные приближения x>0>, x>1>, …, x>n>, …, вычисляемые по формуле (2.5), выполнено условие:

|'(x)| q < 1, (2.7)

то x*

= x>n>.

x>n>.

т. е. итерационный процесс сходится и справедлива следующая оценка погрешности:

|x>n> – x*| qn|x>0> – x*| (2.8)

Оценка (2.8) является априорной. Она показывает, что метод простой итерации сходится со скоростью геометрической прогрессии с знаменателем q. Чем меньше q, тем выше скорость сходимости.

Как следует из теоремы 2.2, условие (2.7) является достаточным для сходимости метода простых итераций. Его выполнение гарантирует сходимость процесса (2.5), но невыполнение условия (2.7), вообще говоря, не означает, что итерационный процесс будет расходиться.

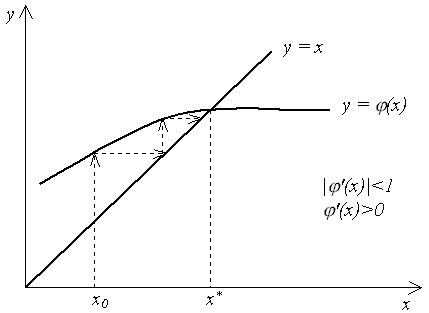

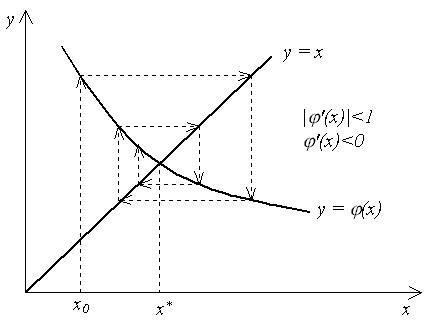

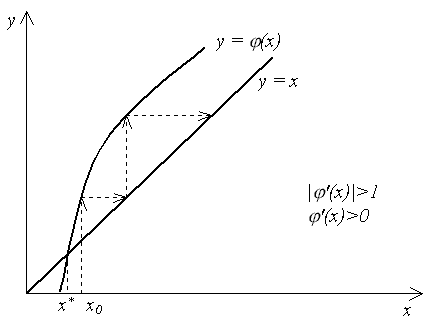

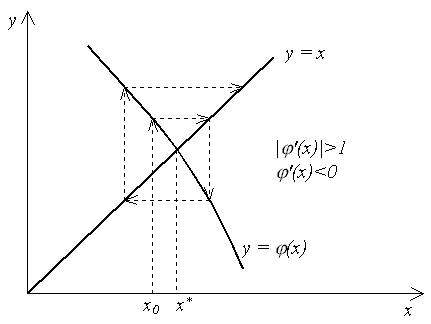

На рис. 2.3 – 2.6 показаны четыре случая взаимного расположения линий y = x и y = (x) и соответствующие итерационные процессы.

Рис. 2.3 и 2.4 соответствуют случаю |'(x)| < 1, и итерационный процесс сходится. При этом, если '(x) > 0 (рис. 2.3), сходимость носит односторонний характер, а если '(x) < 0 (рис. 2.4), сходимость носит двусторонний, колебательный характер. Рис. 2.5 и 2.6 соответствуют случаю |'(x)| > 1 – итерационный процесс расходится. При этом может быть односторонняя (рис. 2.5) и двусторонняя (рис 2.6) расходимость.

Рис. 2.3 Рис. 2.4 Рис. 2.5

Рис. 2.6

Погрешность метода. Если известна величина q в условии (2.7), то применима следующая апостериорная оценка погрешности:

|x>n>

– x*|

|x>n>

– x>n – >>1>|,

n > 1.

(2.9)

|x>n>

– x>n – >>1>|,

n > 1.

(2.9)

Критерий окончания. Из оценки (2.9) вытекает следующий критерий окончания итерационного процесса. Вычисления следует продолжать до выполнения неравенства

|x>n>

– x>n –>>

1>| <

.

.

Если это условие выполнено, то можно считать, что x>n> является приближением к x* с точностью .

Если q 0.5, то можно пользоваться более простым критерием окончания:

|x>n> – x>n – >>1>| < . (2.10)

Пример 2.2.

Используем метод простой итерации для решения уравнения f(x) = sin x – x2 = 0 с точностью = 0.001.

Преобразуем уравнение к виду (2.4):

x =

,

т. е. (x)=

,

т. е. (x)=

.

.

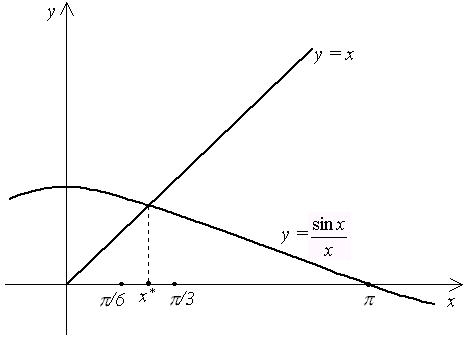

Нетрудно убедиться, что корень уравнения находится на отрезке [/6, /3]. Например, вычислив значения f(x) на концах отрезка, получим: f(/6)> 0, а f(/3)< 0, т. е. функция на концах отрезка имеет разные знаки, что в соответствии с теоремой 2.1 указывает на то, что внутри отрезка есть корень. Расположение корня наглядно иллюстрирует рис.2.7.

Рис. 2.7

Подсчитаем, первую и вторую производные функции (x):

'(x)

=

,

"(x)

=

,

"(x)

=

.

.

Так как "(x) > 0 на отрезке [/6, /3], то производная '(x) монотонно возрастает на этом отрезке и принимает максимальное значение на правом конце отрезка, т. е. в точке /3. Поэтому, справедлива оценка:

| '(x)| | '(/3)| 0.312.

Таким образом, условие (2.7) выполнено, q < 0.5, и можно воспользоваться критерием окончания вычислений в виде (2.10). В табл. 2.2 приведены приближения, полученные по расчетной формуле (2.5). В качестве начального приближения выбрано значение x>0> = 1.

Таблица 2.2

-

n

x>n>

0

1

2

3

4

5

1

0.8415

0.8861

0.8742

0.8774

0.8765

Критерий

окончания выполняется при n

= 5, |x>5>

– x>4>| <

0.001. Сходимость

двусторонняя, качественный характер

такой сходимости представлен на рис.

2.4. Приближенное значение корня с

требуемой точностью x*

0.8765.

0.8765.

2.5 Метод Ньютона (метод касательных)

Метод Ньютона является наиболее эффективным методом решения нелинейных уравнений.

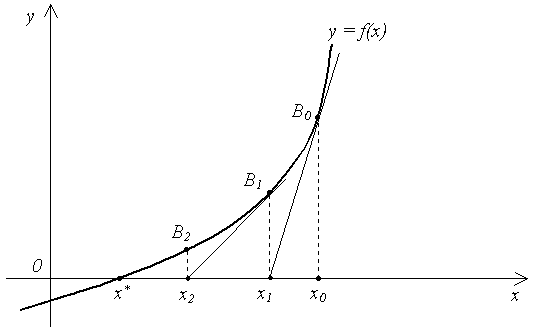

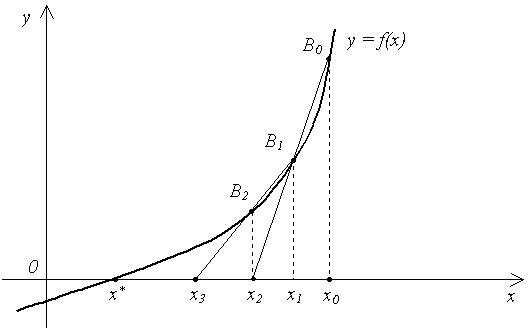

Пусть корень x* [a, b], так, что f(a)f(b) < 0. Предполагаем, что функция f(x) непрерывна на отрезке [a, b] и дважды непрерывно дифференцируема на интервале (a, b). Положим x>0> = b. Проведем касательную к графику функции y = f(x) в точке B>0> = (x>0>, f(x>0>)) (рис. 2.8).

Рис. 2.8

Уравнение касательной будет иметь вид:

y – f(x>0>) = f '(x>0>)(x – x>0>). (2.11)

Первое пересечение получим, взяв абсциссу точки пересечения этой касательной с осью OX, т. е. положив в (2.11) y = 0, x = x>1>:

x>1>

= x>0>

–

.

(2.12)

.

(2.12)

Аналогично поступим с точкой B>1>(x>1>, f(x>1>)), затем с точкой B>2>(x>2>, f(x>2>)), и т. д. в результате получим последовательность приближений x>1>, x>2>, …, x>n >, …,причем

x>n

+1 >= x>n

>–

.

(2.13)

.

(2.13)

Формула (2.13) является расчетной формулой метода Ньютона.

Метод Ньютона можно рассматривать как частный случай метода простых итераций, для которого

(x)

= x -

.

(2.14)

.

(2.14)

Сходимость метода. Сходимость метода Ньютона устанавливает следующая теорема.

Теорема 2.3. Пусть x* – простой корень уравнения f(x) = 0, и в некоторой окрестности этого корня функция f дважды непрерывно дифференцируема. Тогда найдется такая малая -окрестность корня x*, что при произвольном выборе начального приближения x>0> из этой окрестности итерационная последовательность, определенная по формуле (2.13) не выходит за пределы этой окрестности и справедлива оценка:

|x>n

+ >>1> –

x*|

C |x>n>

– x*|2,

n 0, (2.15)

0, (2.15)

где С = -1. Оценка (2.15) означает, что метод сходится с квадратичной скоростью.

Сходимость метода Ньютона зависит от того, насколько близко к корню выбрано начальное приближение. Неудачный выбор начального приближения может дать расходящуюся последовательность. Полезно иметь в виду следующее достаточное условие сходимости метода. Пусть [a, b] – отрезок, содержащий корень. Если в качестве начального приближения x>0> выбрать тот из концов отрезка, для которого

f(x)f"(x) 0, (2.16)

то итерации (2.13) сходятся, причем монотонно. Рис. 2.8 соответствует случаю, когда в качестве начального приближения был выбран правый конец отрезка: x>0> = b.

Погрешность метода. Оценка (2.15) является априорной и неудобна для практического использования. На практике удобно пользоваться следующей апостериорной оценкой погрешности:

|x>n> – x*| |x>n> – x>n – >>1>|. (2.17)

Критерий окончания. Оценка (2.17) позволяет сформулировать следующий критерий окончания итераций метода Ньютона. При заданной точности > 0 вычисления нужно вести до тех пор, пока не будет выполнено неравенство

|x>n> – x>n – >>1>| < . (2.18)

Пример 2.3.

Применим

метод Ньютона для вычисления

.

где a > 0, p

– натуральное число. Вычисление

.

где a > 0, p

– натуральное число. Вычисление

эквивалентно решению уравнения xp

= a. Таким образом, нужно

найти корень уравнения f(x)

= 0, f(x)

= xp

– a, f '(x)

= pxp – 1.

Итерационная формула метода (2.13) примет

вид:

эквивалентно решению уравнения xp

= a. Таким образом, нужно

найти корень уравнения f(x)

= 0, f(x)

= xp

– a, f '(x)

= pxp – 1.

Итерационная формула метода (2.13) примет

вид:

x>n

+1 >= x>n

>–

=

=

x>n >

+

x>n >

+

.

(2.19)

.

(2.19)

Используя

формулу (2.19), найдем

с

точностью

= 10-3.

с

точностью

= 10-3.

x>n

+1 >=

x>n >

+

x>n >

+

.

.

Простой корень уравнения x3 – 7 = 0 расположен на отрезке [1, 2]. Действительно, на концах отрезка [1, 2] функция f(x) = x3 – 7 принимает разные знаки, f (1) < 0, f (2) > 0. Кроме того, при x = 2 выполнено достаточное условие сходимости (2.16): f (2)f" (2) 0.

Поэтому в качестве начального приближения можно взять x>0> = 2.

Результаты приведены в табл. 2.3.

Таблица 2.3

-

n

x>n>

0

1

2

3

4

5

2

0.8415

0.8861

0.8742

0.8774

0.8765

2.6 Метод секущих (метод хорд)

В этом и следующем разделе рассмотрим модификации метода Ньютона.

Как видно из формулы (2.13), метод Ньютона требует для своей реализации вычисления производной, что ограничивает его применение. Метод секущих лишен этого недостатка. Если производную заменить ее приближением:

f

'(x>n>)

,

,

то вместо формулы (2.13) получим

x>n

+1 >= x>n

>–.

.

(2.20)

.

(2.20)

Это означает, что касательные заменены секущими. Метод секущих является двухшаговым методом, для вычисления приближения x>n +1 > необходимо вычислить два предыдущих приближения x>n> и x>n – 1 >, и, в частности, на первой итерации надо знать два начальных значения x>0 >и x>1>.

Формула (2.20) является расчетной формулой метода секущих. На рис. 2.9 приведена геометрическая иллюстрация метода секущих.

Рис. 2.9

Очередное приближение x>n +1 >получается как точка пересечения с осью OX секущей, соединяющей точки графика функции f(x)> > с координатами (x>n -1>, f(x>n - 1>)) и (x>n >, f(x>n>)).

Сходимость метода. Сходимость метода секущих устанавливает следующая теорема.

Теорема 2.4 Пусть x* – простой корень уравнения f(x) = 0, и в некоторой окрестности этого корня функция f дважды непрерывно дифференцируема, причем f"(x) 0. Тогда найдется такая малая -окрестность корня x*, что при произвольном выборе начальных приближений x>0> и> >x>1> из этой окрестности итерационная последовательность, определенная по формуле (2.20) сходится и справедлива оценка:

|x>n

+ >>1>

– x*|

C |x>n>

– x*|

p,

n

0, p

=

1.618. (2.21)

1.618. (2.21)

Сравнение оценок (2.15) и (2.21) показывает, что p < 2, и метод секущих сходится медленнее, чем метод Ньютона. Но в методе Ньютона на каждой итерации надо вычислять и функцию, и производную, а в методе секущих – только функцию. Поэтому при одинаковом объеме вычислений в методе секущих можно сделать примерно вдвое больше итераций и получить более высокую точность.

Так же, как и метод Ньютона, при неудачном выборе начальных приближений (вдали от корня) метод секущих может расходиться. Кроме того применение метода секущих осложняется из-за того, что в знаменатель расчетной формулы метода (2.20) входит разность значений функции. Вблизи корня эта разность мала, и метод теряет устойчивость.

Критерий окончания. Критерий окончания итераций метода секущих такой же, как и для метода Ньютона. При заданной точности > 0 вычисления нужно вести до тех пор, пока не будет выполнено неравенство

|x>n> – x>n – >>1>| < . (2.22)

Пример 2.4.

Применим метод секущих для вычисления положительного корня уравнения 4(1 – x2) – ex = 0 с точностью = 10-3.

Корень этого уравнения находится на отрезке [0, 1], так как f (0) = 3 > 0, а f (1) = –e < 0. Подсчитаем вторую производную функции: f "(x) = –8 – ex. Условие f(x)f " (x) 0 выполняется для точки b = 1. В качестве начального приближения возьмем x>0> = b = 1. В качестве второго начального значения возьмем x>1>> >= 0.5. Проведем вычисления по расчетной формуле (2.20). Результаты приведены в табл. 2.4.

Таблица 2.4

-

n

x>n>

0

1

2

3

4

5

1.0000

0.5000

0.6660

0.7093

0.7033

0.7034

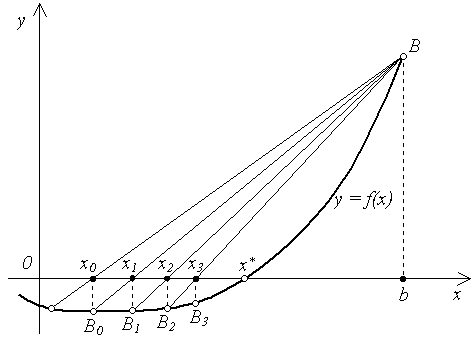

2.7 Метод ложного положения

Рассмотрим еще одну модификацию метода Ньютона.

Пусть известно, что простой корень x* уравнения f(x) = 0 находится на отрезке [a, b] и на одном из концов отрезка выполняется условие f(x)f"(x) 0. Возьмем эту точку в качестве начального приближения. Пусть для определенности это будет b. Положим x>0> = a. Будем проводить из точки B = (b, f(b)) прямые через расположенные на графике функции точки B>n >с координатами (x>n>, f(x>n>), n = 0, 1, … . Абсцисса точки пересечения такой прямой с осью OX есть очередное приближение x>n+>>1>.

Геометрическая иллюстрация метода приведена на рис. 2.10.

Рис. 2.10

Прямые на этом рисунке заменяют касательные в методе Ньютона (рис. 2.8). Эта замена основана на приближенном равенстве

f

'(x>n>)

.

(2.23)

.

(2.23)

Заменим в расчетной формуле Ньютона (2.13) производную f '(x>n>) правой частью приближенного равенства (2.23). В результате получим расчетную формулу метода ложного положения:

x>n

+1 >= x>n

>–. .

(2.24)

.

(2.24)

Метод ложного положения обладает только линейной сходимостью. Сходимость тем выше, чем меньше отрезок [a, b].

Критерий окончания. Критерий окончания итераций метода ложного положения такой же, как и для метода Ньютона. При заданной точности > 0 вычисления нужно вести до тех пор, пока не будет выполнено неравенство

|x>n> – x>n – >>1>| < . (2.25)

Пример 2.5.

Применим метод ложного положения для вычисления корня уравнения x3 + 2x – 11 = 0 с точностью = 10-3.

Корень этого уравнения находится на отрезке [1, 2], так как f (1) = –8 < 0, а f (2) = 1 > 0. Для ускорения сходимости возьмем более узкий отрезок [1.9, 2], поскольку f (1.9) < 0, а f (2) > 0. Вторая производная функции f (x) = x3 + 2x – 11 равна 6x. Условие f(x)f"(x) 0 выполняется для точки b = 2. В качестве начального приближения возьмем x>0> = a = 1.9. По формуле (2.24) имеем

x>1

>= x>0

>–. = 1.9 +

= 1.9 +

1.9254.

1.9254.

Продолжая итерационный процесс, получим результаты, приведенные в табл. 2.5.

Таблица 2.5

-

n

x>n>

0

1

2

3

1.9

1.9254

1.9263

1.9263

Тема 3. Решение систем линейных алгебраических уравнений

3.1 Постановка задачи

Требуется найти решение системы линейных уравнений:

a >11>x>1>

+ a>12>>

>x>2>

+ a>13>x>3>

+ … + a>1>>n>x>n

>= b>1>

>11>x>1>

+ a>12>>

>x>2>

+ a>13>x>3>

+ … + a>1>>n>x>n

>= b>1>

a>21>x>1> + a>22>> >x>2> + a>23>x>3> + … + a>2>>n>x>n >= b>2>

a>31>x>1> + a>32>> >x>2> + a>33>x>3> + … + a>3>>n>x>n >= b>3> (3.1)

.

a>n>>1>x>1> + a>n>>2>> >x>2> + a>n>>3>x>3> + … + a>nn>x>n >= b>n>

или в матричной форме:

Ax = b, (3.2)

г де

де

a

>11

>a>12

>a>13>

… a>1>>n

>x>1>

b>1>

>11

>a>12

>a>13>

… a>1>>n

>x>1>

b>1>

a>21 >a>22>> >a>23> … a>2>>n >x>2>> >b>2>

A = a>31> a>32>> > a>33> … a>3>>n>> > x =x>3>> , >b =b>3>

a>n>>1 >a>n>>2 >a>n>>3 >a>nn >x>n >b>n>

По

правилу Крамера система n

линейных уравнений имеет единственное

решение, если определитель системы

отличен от нуля (det A

0)

и значение каждого из неизвестных

определяется следующим образом:

0)

и значение каждого из неизвестных

определяется следующим образом:

x>j>

=

,

j = 1,

…, n,

(3.3)

,

j = 1,

…, n,

(3.3)

где det A>j> – определитель матрицы, получаемой заменой j-го столбца матрицы A столбцом правых частей> >b.

Непосредственный расчет определителей для больших n является очень трудоемким по сравнению с вычислительными методами.

Известные в настоящее время многочисленные приближенные методы решения систем линейных алгебраических уравнений распадаются на две большие группы: прямые методы и методы итераций.

Прямые методы всегда гарантируют получение решения, если оно существуют, однако, для больших n требуется большое количество операций, и возникает опасность накопления погрешностей.

Этого недостатка лишены итерационные методы, но зато они не всегда сходятся и могут применяться лишь для систем определенных классов.

Среди прямых методов наиболее распространенным является метод исключения Гаусса и его модификации, Наиболее распространенными итерационными методами является метод простых итераций Якоби и метод Зейделя.

Эти методы будут рассмотрены в следующих разделах.

3.2 Метод исключения Гаусса. Схема единственного деления

Основная идея метода исключений Гаусса состоит в том, что система уравнений (3.1) приводится к эквивалентной ей системе с верхней треугольной матрицей (прямой ход исключений), а затем неизвестные вычисляются последовательной подстановкой (обратный ход исключений).

Рассмотрим сначала простейший метод исключения Гаусса, называемый схемой единственного деления.

Прямой ход состоит из n – 1 шагов. На первом шаге исключается переменная x>1> из всех уравнений, кроме первого. Для этого нужно из второго, третьего, …, n-го уравнений вычесть первое, умноженное на величину

m =

=

,

i = 2,

3, …, n.

(3.4)

,

i = 2,

3, …, n.

(3.4)

При этом коэффициенты при x>1 >обратятся в нуль во всех уравнениях, кроме первого.

Введем обозначения:

a = a>ij>

– m

= a>ij>

– m a>1>>j>

, b

a>1>>j>

, b =

b>i>

– m

=

b>i>

– m b>1>.

(3.5)

b>1>.

(3.5)

Легко

убедиться, что для всех уравнений,

начиная со второго, a =

0, i = 2, 3, …, n.

Преобразованная система

запишется в виде:

=

0, i = 2, 3, …, n.

Преобразованная система

запишется в виде:

a>11>x>1>

+ a>12>>

>x>2>

+ a>13>x>3>

+ … + a>1>>n>x>n

>= b>1>

a>11>x>1>

+ a>12>>

>x>2>

+ a>13>x>3>

+ … + a>1>>n>x>n

>= b>1>

a x>2>

+ a

x>2>

+ a x>3>

+ … + a

x>3>

+ … + a x>n

>= b

x>n

>= b

a >

>x>2>

+ a

>

>x>2>

+ a x>3>

+ … + a

x>3>

+ … + a x>n

>= b

x>n

>= b (3.6)

(3.6)

a x>2>

+ a

x>2>

+ a x>3>

+ … + a

x>3>

+ … + a x>n

>= b

x>n

>= b

Все уравнения (3.6), кроме первого, образуют систему (n – 1)-го порядка. Применяя к ней ту же процедуру, мы можем исключить из третьего, четвертого, …, n-го уравнений переменную x>2>. Точно так же исключаем переменную x>3 >из последних n – 3 уравнений.

На

некотором k-ом

шаге в предположении, что главный

элемент k-ого шага a

0,

переменная x>k>

исключается с помощью формул:

0,

переменная x>k>

исключается с помощью формул:

m =

=

,

,

a = a

= a – m

– m a

a ,

,

b =

b

=

b – m

– m b

b ,

i,

j = k + 1, k

+ 2,

…, n.

(3.7)

,

i,

j = k + 1, k

+ 2,

…, n.

(3.7)

Индекс k принимает значения 1, 2, …, n – 1.

При k = n – 1 получим треугольную систему:

a >11>x>1>

+ a>12>>

>x>2>

+ a>13>x>3>

+ … + a>1>>n>x>n

>= b>1>

>11>x>1>

+ a>12>>

>x>2>

+ a>13>x>3>

+ … + a>1>>n>x>n

>= b>1>

a x>2>

+ a

x>2>

+ a x>3>

+ …+ a

x>3>

+ …+ a x>n

>= b

x>n

>= b

a x>3>

+ …+ a

x>3>

+ …+ a x>n

>= b

x>n

>= b (3.8)

(3.8)

a x>n

>= b

x>n

>= b

с треугольной матрицей A>n>.

Приведение системы (3.1) к треугольному виду (3.8) составляет прямой ход метода Гаусса.

При

использовании метода Гаусса нет

необходимости в предварительном

обосновании существования и единственности

решения (т. е. доказательства, что det A

0). Если на k-ом

шаге все элементы a (i = k,

k +

1, …, n)

окажутся равными нулю, то система (3.1)

не имеет единственного решения.

(i = k,

k +

1, …, n)

окажутся равными нулю, то система (3.1)

не имеет единственного решения.

Обратный ход состоит в вычислении переменных. Из последнего уравнения (3.8) определяем x>n>>..>. Подставляя его в предпоследнее уравнение, находим x>n->>1>, и т. д. Общие формулы имеют вид:

x>n

> =

,

,

x>k

> =

(b

(b -

a

-

a x>k+>>1>

- a

x>k+>>1>

- a x>k+>>2>

- … - a

x>k+>>2>

- … - a x>n>),

k = n – 1, n

– 2, …, 1 (3.9)

x>n>),

k = n – 1, n

– 2, …, 1 (3.9)

Трудоемкость метода. Для реализации метода исключения Гаусса требуется примерно 2/3n3 операций для прямого хода и n2 операций для обратного хода. Таким образом, общее количество операций составляет примерно 2/3n3 + n2.

Пример 3.1.

Применим метод исключения Гаусса по схеме единственного деления для решения системы уравнений:

2 .0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

.0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

0.4x>1> + 0.5x>2> + 4.0x>3>> > – 8.5x>4>> >= 21.9

0.3x>1>> > – 1.0x>2> + 1.0x>3> + 5.2x>4>> >= – 3.9 (3.10)

1.0x>1> + 0.2x>2> + 2.5x>3>> > – 1.0x>4>> >= 9.9

Будем делать округление чисел до четырех знаков после десятичной точки.

Прямой ход. 1-ый шаг. Вычислим множители:

m

=

=

=

=

= 0.2; m

= 0.2; m =

=

=

=

= 0.15; m

= 0.15; m =

=

=

=

= 0.5.

= 0.5.

Вычитая

из второго, третьего и четвертого

уравнений системы (3.10) первое уравнение,

умноженное соответственно на m ,

m

,

m ,

m

,

m ,

получим новую систему:

,

получим новую систему:

2 .0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

.0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

0.3x>2> + 4.02x>3> – 8.70x>4>> >= 21.36

–1.15x>2> + 1.015x>3> + 5.05x>4>> >= – 4.305 (3. 11)

– 0.30x>2> + 2.55x>3>> > – 1.50x>4>> >= 8.55

2-ой шаг. Вычислим множители:

m =

=

=

=

= – 3.83333; m

= – 3.83333; m =

=

=

=

= –1.0.

= –1.0.

Вычитая

из третьего и четвертого уравнений

системы (3.11) второе уравнение, умноженное

соответственно на m и m

и m ,

приходим к системе:

,

приходим к системе:

2 .0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

.0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

0.3x>2> + 4.02x>3> – 8.70x>4>> >= 21.36

16. 425x>3>> > – 28.300x>4>> >= 77.575 (3.12)

6.570x>3>> > – 10.200x>4>> >= 29.910

3-ий шаг. Вычислим множитель:

m =

=

=

=

= 0.4.

= 0.4.

Вычитая

из четвертого уравнения системы (3.12)

третье, умноженное на m ,

приведем систему к треугольному виду:

,

приведем систему к треугольному виду:

2 .0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

.0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

0.3x>2> + 4.02x>3> – 8.70x>4>> >= 21.36

16. 425x>3>> > – 28.300x>4>> >= 77.575 (3.13)

1.12x>4>> >= –1.12

Обратный ход. Из последнего уравнения системы (3.13) находим x>4>> >= 1.000. Подставляя значение x>4>> > в третье уравнение, получим x>3>> >= 2.000. Подставляя найденные значения x>4>> > и x>3> во второе уравнение, найдем x>2> = 3.000. Наконец, из первого уравнения, подставив в него найденные значения x>4>, x>3> и x>2>, вычислим x>1>> >= –1.000.

Итак система (3.10) имеет следующее решение:

x>1>> >= 1.000, x>2> = 2.000, x>3>> >= 3.000, x>4>> >= – 1.000.

3.3 Метод исключения Гаусса с выбором главного элемента по столбцу

Хотя

метод Гаусса является точным методом,

ошибки округления могут привести к

существенным погрешностям результата.

Кроме того исключение по формулам (3.7)

нельзя проводить, если элемент главной

диагонали a равен нулю. Если элемент a

равен нулю. Если элемент a мал, то велики ошибки

округления при делении на этот элемент.

Для уменьшения ошибок округления

применяют метод исключения

Гаусса с выбором главного элемента по

столбцу. Прямой ход так

же, как и для схемы единственного деления,

состоит из n –

1 шагов. На первом шаге прежде, чем

исключать переменную x>1>,

уравнения переставляются так, чтобы в

левом верхнем углу был наибольший по

модулю коэффициент a>i>>1>,

i = 1, 2, …, n.

В дальнейшем, на k-м

шаге, прежде, чем исключать переменную

x>k>,

уравнения переставляются так, чтобы в

левом верхнем углу был наибольший по

модулю коэффициент a>ik>,

i = k, k + 1, …, n.

После этой перестановки

исключение переменной x>k

>производят, как в схеме

единственного деления.

мал, то велики ошибки

округления при делении на этот элемент.

Для уменьшения ошибок округления

применяют метод исключения

Гаусса с выбором главного элемента по

столбцу. Прямой ход так

же, как и для схемы единственного деления,

состоит из n –

1 шагов. На первом шаге прежде, чем

исключать переменную x>1>,

уравнения переставляются так, чтобы в

левом верхнем углу был наибольший по

модулю коэффициент a>i>>1>,

i = 1, 2, …, n.

В дальнейшем, на k-м

шаге, прежде, чем исключать переменную

x>k>,

уравнения переставляются так, чтобы в

левом верхнем углу был наибольший по

модулю коэффициент a>ik>,

i = k, k + 1, …, n.

После этой перестановки

исключение переменной x>k

>производят, как в схеме

единственного деления.

Трудоемкость метода. Дополнительные действия по выбору главных элементов требуют примерно n2 операций, что практически не влияет на общую трудоемкость метода.

Пример 3.2.

Применим метод исключения Гаусса с выбором главного элемента по столбцу для решения системы уравнений (3.10) из примера 3.1. Прямой ход. 1-ый шаг. Так как коэффициент a>11> = 2.0 наибольший из коэффициентов первого столбца, перестановки строк не требуется и 1-ый шаг полностью совпадает с 1-ым шагом примера 3.1. Из второго, третьего и четвертого уравнений исключается переменная x>1> и система приводится к виду (3.11).

2-ой

шаг. Наибольший по модулю коэффициент

при x>2>

в системе (3.11) a = –1.15. Поэтому

переставим уравнения следующим образом:

= –1.15. Поэтому

переставим уравнения следующим образом:

2 .0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

.0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

–1.15x>2> + 1.015x>3> + 5.05x>4>> >= – 4.305 (3.14)

0.3x>2> + 4.02x>3> – 8.70x>4>> >= 21.36

– 0.30x>2> + 2.55x>3>> > – 1.50x>4>> >= 8.55

Вычислим множители:

m =

=

=

=

= –0.26087 m

= –0.26087 m =

=

=

=

= 0.26087.

= 0.26087.

Вычитая

из третьего и четвертого уравнений

системы (3.14) второе уравнение, умноженное

соответственно на m и m

и m ,

приходим к системе:

,

приходим к системе:

2 .0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

.0x>1>

+ 1.0x>2>>

>–

0.1x>3>

+ 1.0x>4>>

>= 2.7

–1.15x>2> + 1.015x>3> + 5.05x>4>> >= – 4.305 (3.15)

4.28478x>3> – 7.38261x>4>> >= 20.23696

2.28522x>3>> > – 2.81739x>4>> >= 9.67305

3-ий шаг. Вычислим множитель:

m =

=

=

=

= 0.53333.

= 0.53333.

Вычитая

из четвертого уравнения системы (3.15)

третье, умноженное на m ,

приведем систему к треугольному виду:

,

приведем систему к треугольному виду:

2 .0x>1>

+ 1.0x>2>>

>– 0.1x>3>

+ 1.0x>4>>

>= 2.7

.0x>1>

+ 1.0x>2>>

>– 0.1x>3>

+ 1.0x>4>>

>= 2.7

–1.15x>2> + 1.015x>3> + 5.05x>4>> >= – 4.305 (3.16)

4.28478x>3> – 7.38261x>4>> >= 20.23696

1.11998x>4>> >= –1.11998

Обратный ход. Обратный ход полностью совпадает с обратным ходом примера 3.1. Решение системы имеет вид:

x>1>> >= 1.000, x>2> = 2.000, x>3>> >= 3.000, x>4>> >= – 1.000.

3.4 Вычисление определителя методом исключения Гаусса

Из курса линейной алгебры известно, что определитель треугольной матрицы равен произведению диагональных элементов. В результате метода исключений Гаусса система линейных уравнений (3.2) с квадратной матрицей A приводится к эквивалентной ей системе (3.8) с треугольной матрицей A>n>. Поэтому

det A = (–1)s det A>n>,

где s – число перестановок строк, (s = 0, если использовался метод Гаусса по схеме единственного деления).Таким образом,

det

A

= (–1)s

a>11>

a a

a …a

…a (3.17)

(3.17)

Итак, для вычисления определителя det A необходимо выполнить процедуру прямого хода в методе Гаусса для системы уравнений Ax = 0, затем найти произведение главных элементов, стоящих на диагонали треугольной матрицы и умножить это произведение на (–1)s, где s – число перестановок строк.

Пример 3.3.

Вычислим определитель det A =

2

.0

1.0 0.1 1.0

.0

1.0 0.1 1.0

0.4 0.5 4.0 8.5

0.3 1.0 1.0 5.2

1.0 0.2 2.5 1.0

Данный определитель совпадает с определителем системы, рассмотренной в примере 3.1. Он равен произведению диагональных элементов треугольной матрицы (3.13):

det A = 2.0 0.30 16.425 1.12 = 11.0376.

Если же обратиться к примеру 3.2, то, учитывая, что была одна перестановка строк, т.е. s = 1, получим:

det A = (–1) 2.0 (–1.15) 4.28478 1.11998 = 11.0375.

3.5 Вычисление обратной матрицы методом исключения Гаусса

Обратной матрицей к матрице A называется матрица A-1, для которой выполнено соотношение:

A A-1 = E, (3.18)

где E – единичная матрица:

1 0 0 … 0> >

0 0 … 0> >

0 1> > 0 … 0> >

E = 0 0> > 1 … 0> > . (3.19)

0 0 0 … 1> >

Квадратная матрица A называется невырожденной, если det A 0. Всякая невырожденная матрица имеет обратную матрицу.

Вычисление обратной матрицы можно свести к рассмотренной выше задаче решения системы уравнений.

Пусть A – квадратная невырожденная матрица порядка n:

a>11>

a>12>

a>13>

… a>1>>n

>

a>11>

a>12>

a>13>

… a>1>>n

>

a>21> a>22>> > a>23> … a>2>>n >

A = a>31> a>32>> > a>33> … a>3>>n >

a>n>>1> a>n>>2> a>n>>3> … a>nn >

и A-1 – ее обратная матрица:

x>11>

x>12> x>13>

… x>1>>n

>

x>11>

x>12> x>13>

… x>1>>n

>

x>21> x>22>> > x>23> … x>2>>n >

A-1 = x>31> x>32>> > x>33> … x>3>>n >

x>n>>1> x>n>>2> x>n>>3> … x>nn >

Используя соотношения (3.18), (3. 19) и правило умножения матриц, получим систему из n2 уравнений с n2 переменными x>ij>, i, j = 1, 2, …, n. Чтобы получить первый столбец матрицы E, нужно почленно умножить каждую строку матрицы A на первый столбец матрицы A-1 и приравнять полученное произведение соответствующему элементу первого столбца матрицы E. В результате получим систему уравнений:

a >11>x>11>

+ a>12>>

>x>21>

+ a>13>x>31>

+ … + a>1>>n>x>n>>1>>

>= 1

>11>x>11>

+ a>12>>

>x>21>

+ a>13>x>31>

+ … + a>1>>n>x>n>>1>>

>= 1

a>21>x>11> + a>22>> >x>21> + a>23>x>31> + … + a>2>>n>x>n>>1>> >= 0

a>31>x>11> + a>32>> >x>21> + a>33>x>31> + … + a>3>>n>x>n>>1>> >= 0 (3.20)

a>n>>1>x>11> + a>n>>2>> >x>21> + a>n>>3>x>31> + … + a>nn>x>n>>1>> >= 0

Аналогично, чтобы получить второй столбец матрицы E, нужно почленно умножить каждую строку матрицы A на второй столбец матрицы A-1 и приравнять полученное произведение соответствующему элементу второго столбца матрицы E. В результате получим систему уравнений:

a >11>x>12>

+ a>12>>

>x>22>

+ a>13>x>32>

+ … + a>1>>n>x>n>>2>>

>= 0

>11>x>12>

+ a>12>>

>x>22>

+ a>13>x>32>

+ … + a>1>>n>x>n>>2>>

>= 0

a>21>x>12> + a>22>> >x>22> + a>23>x>32> + … + a>2>>n>x>n>>2>> >= 1

a>31>x>12> + a>32>> >x>22> + a>33>x>32> + … + a>3>>n>x>n>>2>> >= 0 (3.21)

a>n>>1>x>12> + a>n>>2>> >x>22> + a>n>>3>x>32> + … + a>nn>x>n>>2>> >= 0

и т. д.

Всего таким образом получим n систем по n уравнений в каждой системе, причем все эти системы имеют одну и ту же матрицу A и отличаются только свободными членами. Приведение матрицы A к треугольной по формулам (3.7) делается при этом только один раз. Затем по последней из формул (3.7) преобразуются все правые части, и для каждой правой части делается обратный ход.

Пример 3.4.

Вычислим обратную матрицу A-1 для матрицы

A = 1.8 –3.8 0.7 –3.7

0 .7

2.1 –2.6 –2.8

.7

2.1 –2.6 –2.8

7.3 8.1 1.7 –4.9

1.9 –4.3 –4.3 –4.7

По формулам (3.7) за три шага прямого хода преобразуем матрицу A в треугольную матрицу

1 .8

–3.8 0.7 –3.7

.8

–3.8 0.7 –3.7

0 3.57778 –2.87222 –1.36111

0 0 17.73577 19.04992

0 0 0 5.40155

Далее, применим процедуру обратного хода четыре раза для столбцов свободных членов, преобразованных по формулам (3.7) из столбцов единичной матрицы:

1 0 0 0

0 1 0 0

0 , 0 , 1 , 0

0 0 0 1

Каждый раз будем получать столбцы матрицы A-1. Опустив промежуточные вычисления, приведем окончательный вид матрицы A-1:

– 0.21121

–0.46003 0.16248 0.26956

0.21121

–0.46003 0.16248 0.26956

–0.03533 0.16873 0.01573 –0.08920

0.23030 0.04607 –0.00944 –0.19885 .

0.23030 0.04607 –0.00944 –0.19885 .

–0.29316 –0.38837 0.06128 0.18513

3.6 Метод простой итерации Якоби

Метод Гаусса обладает довольно сложной вычислительной схемой. Кроме того, при вычислениях накапливается ошибка округления, что может привести к недостаточно точному результату. Рассмотрим метод простой итерации Якоби, свободный от этих недостатков, хотя требующий приведения исходной системы уравнений к специальному виду.

Для того, чтобы применить метод простой итерации, необходимо систему уравнений

Ax = b (3.22)

с квадратной невырожденной матрицей A привести к виду

x = Bx + c, (3.23)

где B – квадратная невырожденная матрица с элементами b>ij>, i, j = 1, 2, …, n, x – вектор-столбец неизвестных x>i>, c – вектор-столбец с элементами c>i>, i = 1, 2, …, n.

Существуют различные способы приведения системы (3.22) к виду (3.23). Рассмотрим самый простой. Представим систему (3.22) в развернутом виде:

a >11>x>1>

+ a>12>>

>x>2>

+ a>13>x>3>

+ … + a>1>>n>x>n

>= b>1>

>11>x>1>

+ a>12>>

>x>2>

+ a>13>x>3>

+ … + a>1>>n>x>n

>= b>1>

a>21>x>1> + a>22>> >x>2> + a>23>x>3> + … + a>2>>n>x>n >= b>2>

a>31>x>1> + a>32>> >x>2> + a>33>x>3> + … + a>3>>n>x>n >= b>3> (3.24)

a>n>>1>x>1> + a>n>>2>> >x>2> + a>n>>3>x>3> + … + a>nn>x>n >= b>n>

Из первого уравнения системы (3.24) выразим неизвестную x>1>:

x>1>

= a (b>1>

– a>12>x>2>>

> – a>13>x>3>

– … – a>1>>n>x>n>),

(b>1>

– a>12>x>2>>

> – a>13>x>3>

– … – a>1>>n>x>n>),

из второго уравнения – неизвестную x>2>:

x>2>

= a (b>2>

– a>21>x>1>>

> – a>23>x>3>

– … – a>2>>n>x>n>),

(b>2>

– a>21>x>1>>

> – a>23>x>3>

– … – a>2>>n>x>n>),

и т. д. В результате получим систему:

x >1>

=

b>12>>

>x>2>

+ b>13>x>3>

+ … + b>1>>,n->>1>x>n->>1>

+ b>1>>n>x>n>

+ c>1>

>1>

=

b>12>>

>x>2>

+ b>13>x>3>

+ … + b>1>>,n->>1>x>n->>1>

+ b>1>>n>x>n>

+ c>1>

x>2> = b>21>x>1>> >+ b>23>x>3> + … + b>2>>,n->>1>x>n->>1>> >+ b>2>>n>x>n >+ c>2>

x>3> = b>31>x>1> + b>32>> >x>2>+ … + b>3>>,n->>1>x>n->>1>> >+> >b>3>>n>x>n > + c>3>> > > >(3.25)

.

x>n>= > >b>n>>1>x>1> + b>n>>2>> >x>2> + b>n>>3>x>3>> > + b>n,n->>1>x>n->>1>> >+ c>n>

Матричная запись системы (3.25) имеет вид (3.23). На главной диагонали матрицы B находятся нулевые элементы, а остальные элементы вычисляются по формулам:

b>ij>

=

,

c>i >=

,

c>i >=

,

i, j = 1,2, …n,

i

,

i, j = 1,2, …n,

i

j.

(3.26)

j.

(3.26)

Очевидно, что диагональные элементы матрицы A должны быть отличны от нуля.

Выберем

произвольно начальное приближение

Обычно в качестве первого приближения

берут x =

c>i> или

x

=

c>i> или

x =

0. Подставим

начальное приближение в правую часть

(3.25). Вычисляя левые части, получим

значения x

=

0. Подставим

начальное приближение в правую часть

(3.25). Вычисляя левые части, получим

значения x ,

x

,

x ,

…, x

,

…, x .

Продолжая этот процесс

дальше, получим последовательность

приближений, причем (k

+ 1)-е приближение строится следующим

образом:

.

Продолжая этот процесс

дальше, получим последовательность

приближений, причем (k

+ 1)-е приближение строится следующим

образом:

x =

b>12>>

>x

=

b>12>>

>x + b>13>

x

+ b>13>

x + … + b>1>>,n->>1>

x

+ … + b>1>>,n->>1>

x + b>1>>n>

x

+ b>1>>n>

x + c>1>

+ c>1>

x

=

b>21>>

>x

=

b>21>>

>x >1>>

>+

b>23>

x

>1>>

>+

b>23>

x + … + b>2>>,n->>1>

x

+ … + b>2>>,n->>1>

x > >+

b>2>>n>

x

> >+

b>2>>n>

x > >+

c>2>

> >+

c>2>

x =

b>31>>

>x

=

b>31>>

>x + b>32>

x

+ b>32>

x + … + b>3>>,n->>1>

x

+ … + b>3>>,n->>1>

x > >+>

>b>3>>n>

x

> >+>

>b>3>>n>

x > >

+ c>3>

… (3.27)

> >

+ c>3>

… (3.27)

x =

> >b>n>>1>x

=

> >b>n>>1>x + b>n>>2>>

>x

+ b>n>>2>>

>x + b>n>>3>

x

+ b>n>>3>

x > >

+ b>n,n->>1>

x

> >

+ b>n,n->>1>

x >

>+

c.>n>

>

>+

c.>n>

Система (3.27) представляет собой расчетные формулы метода простой итерации Якоби.

Сходимость метода простой итерации. Известно следующее достаточное условие сходимости метода простой итерации Якоби.

Если элементы матрицы A удовлетворяют условию:

|a>ii>|

>

,

i = 1,

2, …, n.

(3.28)

,

i = 1,

2, …, n.

(3.28)

то итерационная последовательность xk сходится к точному решению x*.

Условие (3.28) называют условием преобладания диагональных элементов матрицы A, так как оно означает, что модуль диагонального элемента i-ой строки больше суммы модулей остальных элементов этой строки, i = 1, 2, …, n.

Необходимо помнить, что условие сходимости (3.28) является лишь достаточным. Его выполнение гарантирует сходимость метода простых итераций, но его невыполнение, вообще говоря, не означает, что метод расходится.

Справедлива следующая апостериорная оценка погрешности:

max|x - x

- x |

|

max|x

max|x –

x

–

x |,

i = 1,

2, …, n,

(3.29)

|,

i = 1,

2, …, n,

(3.29)

где = max |b>ij>| i, j = 1, 2, …, n.

Правую часть оценки (3.29) легко вычислить после нахождения очередного приближения.

Критерий окончания. Если требуется найти решение с точностью , то в силу (3.29) итерационный процесс следует закончить как только на (k+1)-ом шаге выполнится неравенство:

max|x

max|x –

x

–

x |

< ,

i

= 1, 2, …, n.

(3.30)

|

< ,

i

= 1, 2, …, n.

(3.30)

Поэтому в качестве критерия окончания итерационного процесса можно использовать неравенство

max|x –

x

–

x |

< >1>,

i

= 1, 2, …, n.

(3.31)

|

< >1>,

i

= 1, 2, …, n.

(3.31)

где >1>>

=

>>.>

>>.>

Если

выполняется условие

,

то можно пользоваться более простым

критерием окончания:

,

то можно пользоваться более простым

критерием окончания:

max|x –

x

–

x |

< ,

i

= 1, 2, …, n.

(3.32)

|

< ,

i

= 1, 2, …, n.

(3.32)

В других случаях использование критерия (3.32) неправомерно и может привести к преждевременному окончанию итерационного процесса.

Пример 3.5.

Применим метод простой итерации Якоби для решения системы уравнений

2 0.9x>1>

+ 1.2> >x>2>

+ 2.1x>3>

+ 0.9x>4>>

>= 21.70

0.9x>1>

+ 1.2> >x>2>

+ 2.1x>3>

+ 0.9x>4>>

>= 21.70

1.2x>1> + 21.2> >x>2> + 1.5x>3> + 2.5x>4>> >= 27.46

2.1x>1> + 1.5> >x>2> + 19.8x>3> + 1.3x>4>> >= 28.76 (3.33)

0.9x>1> + 2.5> >x>2> + 1.3x>3> + 32.1x>4>> >= 49.72

Заметим, что метод простой итерации сходится, т. к. выполняется условие преобладания диагональных элементов (3.28):

|20.9| > |1.2 + 2.1 + 0.9|,

|21.2| > |1.2| + |1.5| + |2.5|,

|19.8| > |2.1| + |1.5| + |1.3|,

|32.1| > |0.9| + |2.5| + |1.3|.

Пусть требуемая точность = 10-3. Вычисления будем проводить с четырьмя знаками после десятичной точки.

Приведем систему к виду (3.25):

x >1

> =

– 0.0574>

>x>2>>

> – 0.1005x>3>>

> – 0.0431x>4>>

>+ 1.0383

>1

> =

– 0.0574>

>x>2>>

> – 0.1005x>3>>

> – 0.0431x>4>>

>+ 1.0383

x>2>> > = –0.0566x>1> – 0.0708x>3> – 0.1179x>4>> >+ 1.2953

x>3>> > = –0.1061x>1> – 0.0758> >x>2>> > – 0.0657x>4>> >+ 1.4525 (3.34)

x>4>> > = –0.0280x>1> – 0.0779> >x>2> – 0.0405x>3> + 1.5489

Величина

= max |b>ij>|,

i, j = 1, 2, 3,4 равна 0.1179, т. е.

выполняется условие

,

и можно пользоваться критерием окончания

итерационного процесса (3.32).

,

и можно пользоваться критерием окончания

итерационного процесса (3.32).

В качестве начального приближения возьмем элементы столбца свободных членов:

x = 1.0383, x

= 1.0383, x = 1.2953, x

= 1.2953, x = 1.4525, x

= 1.4525, x = 1.5489.

(3.35)

= 1.5489.

(3.35)

Вычисления

будем вести до тех пор, пока все величины

|x –

x

–

x |,

i = 1, 2, 3, 4, а

следовательно, и max|x

|,

i = 1, 2, 3, 4, а

следовательно, и max|x –

x

–

x |

не станут меньше

= 10-3.

|

не станут меньше

= 10-3.

Последовательно вычисляем:

при k = 1

x > > =

– 0.0574x

> > =

– 0.0574x >

> – 0.1005x

>

> – 0.1005x – 0.0431x

– 0.0431x >

>+ 1.0383 =

0.7512

>

>+ 1.0383 =

0.7512

x >

> = –0.0566x

>

> = –0.0566x – 0.0708x

– 0.0708x – 0.1179x

– 0.1179x >

>+ 1.2953 =

0.9511

>

>+ 1.2953 =

0.9511

x >

> = –0.1061x

>

> = –0.1061x – 0.0758 x

– 0.0758 x >

> –

0.0657x

>

> –

0.0657x >

>+ 1.4525 =

1.1423

>

>+ 1.4525 =

1.1423

x = –0.0280x

= –0.0280x – 0.0779x

– 0.0779x – 0.0405x

– 0.0405x + 1.5489 = 1.3601

+ 1.5489 = 1.3601

при k = 2

x =

0.8106, x

=

0.8106, x =

1.0118, x

=

1.0118, x =

1.2117, x

=

1.2117, x =

1.4077.

=

1.4077.

при k = 3

x =

0.7978, x

=

0.7978, x =

0.9977, x

=

0.9977, x =

1.1975, x

=

1.1975, x =

1.3983.

=

1.3983.

при k = 4

x =

0.8004, x

=

0.8004, x =

1.0005, x

=

1.0005, x =

1.2005, x

=

1.2005, x = 1.4003.

= 1.4003.

Вычисляем

модули разностей значений x при

k = 3 и k

= 4:

при

k = 3 и k

= 4:

|

x –

x

–

x |

= 0.026, | x

|

= 0.026, | x –

x

–

x |

= 0.028, | x

|

= 0.028, | x –

x

–

x |

= 0.0030, | x

|

= 0.0030, | x –

x

–

x |

= 0.0020.

|

= 0.0020.

Так как все они больше заданной точности = 10-3, продолжаем итерации.

При k = 5

x =

0.7999, x

=

0.7999, x =

0.9999, x

=

0.9999, x =

1.1999, x

=

1.1999, x = 1.3999.

= 1.3999.

Вычисляем

модули разностей значений x при

k = 4 и k

= 5:

при

k = 4 и k

= 5:

|

x –

x

–

x |

= 0.0005, | x

|

= 0.0005, | x –

x

–

x |

= 0.0006, | x

|

= 0.0006, | x – x

– x |

= 0.0006, | x

|

= 0.0006, | x –

x

–

x |

= 0.0004.

|

= 0.0004.

Все они меньше заданной точности = 10-3, поэтому итерации заканчиваем. Приближенным решением системы являются следующие значения:

x>1>>

>

0.7999, x>2>>

>

0.7999, x>2>>

>

0.9999, x>3>>

>

0.9999, x>3>>

>

1.1999, x>4>>

>

1.1999, x>4>>

>

1.3999.

>

1.3999.

Для сравнения приведем точные значения переменных:

x>1>> >= 0.8, x>2>> >= 1.0, x>3>> >= 1.2, x>4>> >= 1.4.

3.7 Метод Зейделя

Модификацией метода простых итераций Якоби можно считать метод Зейделя.

В методе

Якоби на (k+1)-ой

итерации значения x ,

i = 1, 2, …, n.

вычисляются подстановкой в правую часть

(3.27) вычисленных на предыдущей итерации

значений x

,

i = 1, 2, …, n.

вычисляются подстановкой в правую часть

(3.27) вычисленных на предыдущей итерации

значений x .

В методе Зейделя при

вычислении x

.

В методе Зейделя при

вычислении x используются

значения x

используются

значения x ,

x

,

x ,

x

,

x ,

уже найденные на (k+1)-ой

итерации, а не x

,

уже найденные на (k+1)-ой

итерации, а не x ,

x

,

x ,

…, x

,

…, x ,

как в методе Якоби, т.е. (k

+ 1)-е приближение строится следующим

образом:

,

как в методе Якоби, т.е. (k

+ 1)-е приближение строится следующим

образом:

x =

b>12>>

>x

=

b>12>>

>x + b>13>

x

+ b>13>

x + … + b>1>>,n->>1>

x

+ … + b>1>>,n->>1>

x + b>1>>n>

x

+ b>1>>n>

x + c>1>

+ c>1>

x =

b>21>>

>x

=

b>21>>

>x >

>+

b>23>

x

>

>+

b>23>

x + … + b>2>>,n->>1>

x

+ … + b>2>>,n->>1>

x + b>2>>n>

x

+ b>2>>n>

x > >+

c>2>

> >+

c>2>

x =

b>31>>

>x

=

b>31>>

>x + b>32>

x

+ b>32>

x + … + b>3>>,n->>1>

x

+ … + b>3>>,n->>1>

x > >+>

>b>3>>n>

x

> >+>

>b>3>>n>

x > >

+ c>3>

(3.36)

> >

+ c>3>

(3.36)

x =

b>n>>1>

x

=

b>n>>1>

x + b>n>>2>>

>x x

+ b>n>>2>>

>x x + b>n>>3>

x x

+ b>n>>3>

x x +

… + b>n,n->>1>

x

+

… + b>n,n->>1>

x >

>+

c.>n>

>

>+

c.>n>

Формулы (3.36) являются расчетными формулами метода Зейделя.

Введем нижнюю и верхнюю треугольные матрицы:

0 0 0 … 0>

>0

b>12>>

> b>13>

… b>1>>n>>

>

0 0 0 … 0>

>0

b>12>>

> b>13>

… b>1>>n>>

>

b>21> 0> > 0 … 0> >0 0> > b>23> … b>2>>n>

B>1> = b>31> b>32>> > 0 … 0 и > >B>2>> >=> >0 0> > 0 … b>3>>n .>

b>n>>1> b>n>>2> b>n>>3> …0> >0 0 0 … 0

Матричная запись расчетных формул (3.36) имеет вид:

xk+1= B>1>xk+1+ B>2>xk+ c. (3.37)

Так как B = B>1>+ B>2>, точное решение x* исходной системы удовлетворяет равенству:

x*= B>1>x*+ B>2>x*+ c. (3.38)

Сходимость метода Зейделя. Достаточным условием сходимости метода Зейделя является выполнение неравенства:

= max |b>ij>|,< 1, i, j = 1, 2, …, n. (3.39)

Неравенство (3.39) означает, что для сходимости метода Зейделя достаточно, чтобы максимальный по модулю элемент матрицы B был меньше единицы.

Если выполнено условие (3.39), то справедлива следующая апостериорная оценка погрешности:

max|x - x

- x |

|

max|x

max|x –

x

–

x |

i = 1,

2, …, n,

(3.40)

|

i = 1,

2, …, n,

(3.40)

где – максимальный элемент матрицы B, >2>> >– максимальный элемент матрицы B>2>.

Правую часть оценки (3.40) легко вычислить после нахождения очередного приближения.

Критерий окончания. Если требуется найти решение с точностью , то в силу (3.37) итерационный процесс следует закончить как только на (k+1)-ом шаге выполнится неравенство:

max|x

max|x –

x

–

x |

< ,

i

= 1, 2, …, n.

(3.41)

|

< ,

i

= 1, 2, …, n.

(3.41)

Поэтому в качестве критерия окончания итерационного процесса можно использовать неравенство

max|x –

x

–

x |

< >1>,

i

= 1, 2, …, n.

(3.42)

|

< >1>,

i

= 1, 2, …, n.

(3.42)

где >1>>

=

>>.>

>>.>

Если

выполняется условие

,

то можно пользоваться более простым

критерием окончания:

,

то можно пользоваться более простым

критерием окончания:

max|x –

x

–

x |

< ,

i

= 1, 2, …, n.

(3.43)

|

< ,

i

= 1, 2, …, n.

(3.43)

Метод Зейделя как правило сходится быстрее, чем метод Якоби. Однако возможны ситуации, когда метод Якоби сходится, а метод Зейделя сходится медленнее или вообще расходится.

Пример 3.6.

Применим метод Зейделя для решения системы уравнений (3.33) из примера 3.5. Первые шаги полностью совпадают с процедурой решения по методу Якоби, а именно: система приводится к виду (3.34), затем в качестве начального приближения выбираются элементы столбца свободных членов (3.35). Проведем теперь итерации методом Зейделя.

При k = 1

x > > =

– 0.0574x

> > =

– 0.0574x >

> – 0.1005x

>

> – 0.1005x – 0.0431x

– 0.0431x >

>+ 1.0383 =

0.7512

>

>+ 1.0383 =

0.7512

При

вычислении x используем

уже полученное значение x

используем

уже полученное значение x :

:

x >

> = –0.0566

x

>

> = –0.0566

x > > –

0.0708x

> > –

0.0708x – 0.1179x

– 0.1179x >

>+ 1.2953 =

0.9674

>

>+ 1.2953 =

0.9674

При

вычислении x используем уже полученные значения x

используем уже полученные значения x и x

и x :

:

x >

> = –0.1061

x

>

> = –0.1061

x – 0.0758 x

– 0.0758 x >

> –

0.0657x

>

> –

0.0657x >

>+ 1.4525 =

1.1977

>

>+ 1.4525 =

1.1977

При

вычислении x используем уже полученные значения x

используем уже полученные значения x ,

x

,

x ,

x

,

x :

:

x = –0.0280 x

= –0.0280 x – 0.0779 x

– 0.0779 x –

0.0405x x

–

0.0405x x + 1.5489 = 1.4037

+ 1.5489 = 1.4037

Аналогичным образом проведем вычисления при k = 2 и k = 3. Получим:

при k = 2

x =

0.8019, x

=

0.8019, x =

0.9996, x

=

0.9996, x =

1.9996, x

=

1.9996, x =

1.4000.

=

1.4000.

при k = 3

x =

0.80006, x

=

0.80006, x =

1.00002, x

=

1.00002, x =

1.19999, x

=

1.19999, x =

1.40000.

=

1.40000.

Известны точные значения переменных:

x>1>> >= 0.8, x>2>> >= 1.0, x>3>> >= 1.2, x>4>> >= 1.4.

Сравнение с примером 3.5 показывает, что метод Зейделя сходится быстрее и дает более точный результат.

Тема 4. Приближение функций

4.1 Постановка задачи

Задача приближения (аппроксимации) функций заключается в том, чтобы для данной функции построить другую, отличную от нее функцию, значения которой достаточно близки к значениям данной функции. Такая задача возникает на практике достаточно часто. Укажем наиболее типичные случаи.

1. Функция задана таблицей в конечном множестве точек, а вычисления нужно произвести в других точках.

2. Функция задана аналитически, но ее вычисление по формуле затруднительно.

При решении задачи поиска приближенной функции возникают следующие проблемы.

1. Необходимо выбрать вид приближенной функции. Для приближения широко используются многочлены, тригонометрические функции, показательные функции и т. д.

2. Необходимо выбрать критерий близости исходной и приближенной функции. Это может быть требование совпадения обеих функций в узловых точках (задача интерполяции), минимизация среднеквадратического уклонения (метод наименьших квадратов) и др.

3. Необходимо указать правило (алгоритм), позволяющее с заданной точностью найти приближение функции.

4.2 Приближение функции многочленами Тейлора

Пусть функция y = f(x) определена в окрестности точки a и имеет в этой окрестности n + 1 производную. Тогда в этой окрестности справедлива формула Тейлора:

f(x) = c>0> + c>1>(x – a) + c>2>(x – a)2 + … + c>n>(x – a )n + R>n>(x) = T>n>(x) + R>n>(x),

где

c>k>

=

T>n>(x) – многочлен Тейлора:

T>n>(x)= c>0> + c>1>(x – a) + c>2>(x – a)2 + … + c>n>(x – a )n, (4.1)

R>n>(x) – остаточный член формулы Тейлора. Его можно записать различными способами, например, в форме Лагранжа:

R>n>(x)=

,

a

x.

,

a

x.

Многочлен Тейлора (4.1) обладает свойством, что в точке x = a все его производные до порядка n включительно совпадают с соответствующими производными функции f, т. е.

T (a)=

f(k)(a),

k = 0, 1, …,

n.

(a)=

f(k)(a),

k = 0, 1, …,

n.

В этом легко убедиться, дифференцируя T>n>(x). Благодаря этому свойству многочлен Тейлора хорошо приближает функцию f в окрестности точки a. Погрешность приближения составляет

|f(x) – T>n>(x)| = |R>n>(x)|,

т. е. задавая некоторую точность > 0, можно определить окрестность точки a и значение n из условия:

|

R>n>(x)|

=

R>n>(x)|

=

< .

(4.2)

< .

(4.2)

Пример 4.1.

Найдем приближение функции y = sinx многочленом Тейлора в окрестности точки a = 0. Воспользуемся известным выражением для k-ой производной функции sinx:

( sinx)(k)

= sin x

+ k

sinx)(k)

= sin x

+ k (4.3)

(4.3)

Применяя последовательно формулу (4.3), получим:

f(0) = sin0 = 0;

f '(0) = cos(0) = 1;

f"(0) = –sin0 = 0;

f(2k-1)(0)

= sin (2k

– 1) = (–1)k – 1

;

= (–1)k – 1

;

f(2k)(0) = 0;

f(2k+1)()

= (–1)kcos .

.

Следовательно, многочлен Тейлора для функции y = sinx для n = 2k имеет вид:

sinx

= x –

+

… + (–1)k

– 1

+

… + (–1)k

– 1

+

R>2>>k>(x),

+

R>2>>k>(x),

R>2>>k>(x)

= (–1)k

.

.

Зададим

= 10 –4

и отрезок [– ,

, ].

Определим n =2k

из неравенства:

].

Определим n =2k

из неравенства:

|R>2>>k>(x)|

=

<

<

<

<

<

= 10-4.

<

= 10-4.

Т аким

образом, на отрезке –

аким

образом, на отрезке – ,

, функция y = sinx с

точностью до

= 10-4

равна многочлену 5-ой степени:

функция y = sinx с

точностью до

= 10-4

равна многочлену 5-ой степени:

sinx

= x

–

+

+

= x

– 0.1667x3

+ 0.0083x5.

= x

– 0.1667x3

+ 0.0083x5.

Пример 4.2.

Найдем приближение функции y = ex многочленом Тейлора на отрезке [0, 1] с точностью = 10 –5.