Случайные величины в статистической радиотехнике

Содержание

1. Основные понятия теории вероятности

2. Случайная величина

3. Основные теоремы теории вероятности

4. Случайные величины и их законы распределения

Библиографический список

1. Основные понятия теории вероятности

Полная группа событий: несколько событий образуют полную группу, если в результате опыта непременно должно появиться хотя бы одно из них.

Несовместные события: несколько событий являются несовместными в данном опыте, если никакие два из них не могут появиться вместе.

Равновозможные события: несколько событий называются равновозможными, если есть основание считать, что ни одно из них не является предпочтительным по сравнению с другими.

Частота события: если производится серия из N опытов, в каждом из которых могло появиться или не появиться некоторое событие А, то частотой события А в данной серии опытов называется отношение числа опытов, в которых появилось событие А, к общему числу произведенных опытов.

Частоту события часто

называют статистической вероятностью

и вычисляют на основании результатов

опыта по формуле

,

где m

– число появлений события А.

,

где m

– число появлений события А.

При небольшом числе опытов N частота может меняться от одной серии опытов к другой из-за случайности событий. Однако при большом числе опытов она носит устойчивый характер и стремится к значению, которое называется вероятностью события.

2. Случайная величина

Случайной величиной (СВ) называется величина, которая в результате опыта может принять то или иное значение, причем неизвестно заранее, какое именно.

Примеры: число попаданий в мишень при ограниченном числе выстрелов; число вызовов по телефону в единицу времени; количество некондиционных транзисторов в партии выпускаемых изделий и т.д.

Случайные величины, принимающие только отдельные значения, которые можно пересчитать, называются дискретными случайными величинами.

Существуют СВ другого типа: значения шумового давления, измеренного в различные моменты времени; вес булки хлеба, продаваемого в магазине и т.д. Называют их непрерывными случайными величинами.

3. Основные теоремы теории вероятности

Сумма и произведение событий. Суммой двух событий А и Б называется событие С, состоящее в выполнении события А, или события Б, или обоих вместе.

Например, если событие А – попадание в мишень при первом выстреле, событие Б – попадание в мишень при втором выстреле, то событие С = А + Б есть попадание в мишень вообще безразлично при каком выстреле – при первом, при втором или при обоих вместе.

Суммой нескольких событий называется событие, состоящее в появлении хотя бы одного из этих событий.

Произведением двух событий А и Б называется событие С, состоящее в совместном выполнении события А и события Б.

Если производится два выстрела по мишени и если событие А есть попадание при первом выстреле, а событие Б – попадание при втором выстреле, то С = А∙Б есть попадание при обоих выстрелах.

Произведением нескольких событий называется событие, состоящее в совместном появлении всех этих событий.

2. Теорема сложения вероятностей. Вероятность суммы двух несовместных событий равна сумме вероятностей этих событий:

.

.

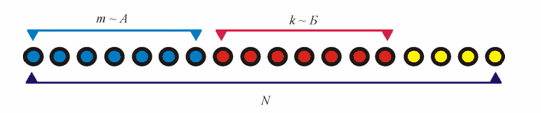

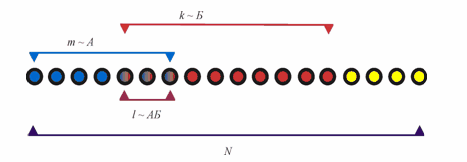

Пусть возможные исходы опыта сводятся к совокупности случаев, которые для наглядности представлены на рис. 1 в виде N символов.

Рис. 1

Предположим, что из этих случаев m благоприятны событию А, а k – событию Б. Тогда

.

.

Так как события А и Б несовместны, то нет случаев, которые благоприятны событиям А и Б вместе. Следовательно, событию А + Б благоприятны m + k случаев и

.

.

Подставляя полученные выражения в формулу для вероятности суммы двух событий, получим тождество.

Следствие Если события А>1>, А>2>, …, А>N> образуют полную группу событий, то сумма их вероятностей равна единице.

Следствие 2. Сумма вероятностей противоположных событий равна единице.

3. Теорема умножения вероятностей. Необходимо ввести понятия независимых и зависимых событий.

Событие А называется независимым от события Б, если вероятность события А не зависит от того, произошло событие Б или нет.

Событие А называется зависимым от события Б, если вероятность события А меняется от того, произошло событие Б или нет.

Вероятность события А, вычисленная при условии, что имело место другое событие В, называется условной вероятностью события А и обозначается P(А/В).

Теорема умножения вероятностей: вероятность произведения двух событий равна произведению вероятности одного из них на условную вероятность другого, вычисленную при условии, что первое имело место:

.

.

Пусть возможные исходы опыта сводятся к N случаям, которые для наглядности даны в виде символов на рис. 2.

Рис. 2

Предположим, что событию А благоприятны m случаев, а событию Б – k случаев. Так как не предполагались события А и Б совместными, то существуют случаи, благоприятные и событию А, и событию Б одновременно. Пусть число таких случаев l. Тогда P(АБ) = l/N; P(A) = m/N. Вычислим P(Б/А), т.е. условную вероятность события Б в предположении, что А имело место. Если известно, что событие А произошло, то из произошедших N случаев остаются возможными только те из m, которые благоприятствовали событию А. Из них l случаев благоприятны событию Б. Следовательно, P(Б/А) = l/m. Подставляя выражения P(АБ), P(A) и P(Б/А) в формулу вероятности произведения двух событий, получим тождество.

Следствие Если событие А не зависит от события Б, то и событие Б не зависит от события А.

Следствие 2. Вероятность произведения двух независимых событий равна произведению этих событий.

4. Формула полной вероятности. Формула полной вероятности является следствием обеих теорем – теоремы сложения вероятностей и теоремы умножения вероятностей.

Пусть требуется определить вероятность некоторого события А, которое может произойти вместе с одним из событий H>1>, H>2>,…, H>N>, образующих полную группу несовместных событий. Будем эти события называть гипотезами. Тогда

,

,

т.е. вероятность события А вычисляется как сумма произведений вероятности каждой гипотезы на вероятность события при этой гипотезе.

Эта формула носит название формулы полной вероятности.

Так как гипотезы H>1>, H>2>,…, H>N> образуют полную группу событий, то событие А может появиться только в комбинации с какой-либо из этих гипотез: А = H>1>А + H>2>А + …+ H>N>А. Так как гипотезы H>1>, H>2>,…, H>N> несовместны, то и комбинации H>1>А, H>2>А, … H>N>А также несовместны. Применяя к ним теорему сложения, получим:

.

.

Применяя к событию H>i>А теорему сложения, получим искомую формулу.

5. Теорема гипотез (формула Байеса). Имеется полная группа несовместных гипотез H>1>, H>2>,…, H>N>. Вероятности этих гипотез до опыта известны и равны соответственно P(H>1>), P(H>2>), …, P(H>N>). Произведем опыт, в результате которого будет наблюдаться появление некоторого события А. Спрашивается, как следует изменить вероятности гипотез в связи с появлением этого события?

Здесь, по существу, идет

речь о том, как найти условную вероятность

для каждой гипотезы после проведения

эксперимента.

для каждой гипотезы после проведения

эксперимента.

Из теоремы умножения имеем:

,

(i = 1, 2, …, N).

,

(i = 1, 2, …, N).

Или, отбрасывая левую часть, получим

,

(i

= 1, 2, …, N),

,

(i

= 1, 2, …, N),

откуда

,

(i = 1, 2, …, N).

,

(i = 1, 2, …, N).

Выражая P(А) с помощью формулы полной вероятности, имеем:

,

(i = 1, 2, …, N).

,

(i = 1, 2, …, N).

Эта формула и носит название формулы Байеса или теоремы гипотез. Используется она в теории проверки статистических гипотез (в частности, в теории обнаружения сигналов на фоне помех).

4. Случайные величины и их законы распределения

Законом распределения СВ называется всякое соотношение, устанавливающее связь между возможными значениями случайной величины и соответствующими им вероятностями. Про случайную величину будем говорить, что она подчинена данному закону распределения.

Простейшей формой задания закона является табл. 1, в которой перечислены возможные значения СВ и соответствующие им вероятности.

Таблица 1

-

x1

x2

…

xN

p1

p2

…

pN

Однако такую таблицу невозможно построить для непрерывной СВ, поскольку для нее каждое отдельное значение не обладает отличной от нуля вероятностью.

Для количественной характеристики распределения используют зависимость вероятности события X < x, где x – некоторая текущая переменная, от x. Эта функция называется функцией распределения СВ X и обозначается F(x): F(x) = P(X < x). Функцию распределения F(x) иногда называют интегральной функцией распределения или интегральным законом распределения.

Функция распределения существует для всех СВ – как непрерывных, так и дискретных.

Сформулируем некоторые общие свойства F(x):

1) F(x) есть неубывающая функция своего аргумента, т.е. при x>2> > x>1> F(x>2>) > F(x>1>);

2) на – F(x) равна нулю, т.е. F(–) = 0;

3) F() =

По определению, F(x) при некотором x есть вероятность попадания СВ X в интервал от – до x.

Для дискретной СВ распределение F(x) имеет ступенчатый вид, причем величина каждого скачка равна вероятности значения, при котором имеется скачок F(x).

При решении практических задач часто необходимо вычислять вероятность того, что СВ примет значение, заключенное в некоторых пределах, например от x>1> до x>2>. Это событие называется «попаданием СВ X на участок от x>1> до x>2>». Выразим вероятность этого события через функцию распределения СВ X. Для этого рассмотрим два события:

– событие А, состоящее в том, что X < x>2>;

– событие В, состоящее в том, что X < x>1>;

– событие С, состоящее в том, что x>1> < X < x>2>.

Учитывая, что А

= В + С,

по теореме сложения вероятностей получим

,

или

,

или

,

откуда

,

откуда

,

т.е. вероятность попадания

СВ на заданный участок равна приращению

функции распределения на этом участке.

,

т.е. вероятность попадания

СВ на заданный участок равна приращению

функции распределения на этом участке.

Пусть имеется непрерывная

СВ X

с функцией распределения F(x),

которую считаем непрерывной и

дифференцируемой. Вычислим вероятность

попадания этой СВ на участок от x

до x

+ x:

,

т.е. эта вероятность равна

приращению функции распределения на

этом участке. Рассмотрим отношение этой

вероятности к длине участка или среднюю

вероятность, приходящуюся на единицу

длины на этом участке. Кроме того,

устремим x

к нулю. В пределе получим производную

от функции распределения:

,

т.е. эта вероятность равна

приращению функции распределения на

этом участке. Рассмотрим отношение этой

вероятности к длине участка или среднюю

вероятность, приходящуюся на единицу

длины на этом участке. Кроме того,

устремим x

к нулю. В пределе получим производную

от функции распределения:

.

.

Обозначим

через f(x).

Полученная функция характеризует

плотность, с

которой распределяется значение СВ в

данной точке x.

Это и есть плотность

вероятности. Иногда ее

называют дифференциальным законом

распределения СВ X.

через f(x).

Полученная функция характеризует

плотность, с

которой распределяется значение СВ в

данной точке x.

Это и есть плотность

вероятности. Иногда ее

называют дифференциальным законом

распределения СВ X.

Если X есть непрерывная СВ с плотностью вероятности f(x), то величина f(x)dx есть элементарная вероятность, соответствующая событию – попаданию СВ X на отрезок dx. Геометрически это есть площадь элементарного прямоугольника, опирающегося на отрезок dx и ограниченного сверху функцией f(x).

Свойства плотности вероятности:

1)

при всех x,

поскольку вероятность не может быть

отрицательной (кроме того, производная

неубывающей функции не может быть

отрицательной);

при всех x,

поскольку вероятность не может быть

отрицательной (кроме того, производная

неубывающей функции не может быть

отрицательной);

2)

;

;

3)

;

;

4) свойство нормировки

,

т.е. площадь, ограниченная графиком

плотности вероятности и осью x,

всегда равна 1 (кроме того, попадание СВ

X

в неограниченную с обеих сторон ось x

является достоверным событием).

,

т.е. площадь, ограниченная графиком

плотности вероятности и осью x,

всегда равна 1 (кроме того, попадание СВ

X

в неограниченную с обеих сторон ось x

является достоверным событием).

Во многих практических ситуациях нет необходимости характеризовать СВ плотностью вероятности. Часто бывает достаточно указать только отдельные числовые параметры, характеризующие в какой-то степени существенные черты распределения СВ, например, среднее значение, вокруг которого группируются возможные значения СВ; число, характеризующее степень разбросанности этих значений относительно среднего значения и т.д. Такие характеристики называются числовыми характеристиками СВ.

Математическое ожидание

(МО) иногда называют средним значением

СВ. Оно обозначается

и для дискретной СВ определяется по

формуле

и для дискретной СВ определяется по

формуле

.

.

Это среднее взвешенное значение и называют МО.

Математическим ожиданием СВ называют сумму произведений всех возможных значений СВ на вероятности этих значений.

Математическое ожидание СВ X связано со средним арифметическим значением наблюдаемых значений СВ при большом числе опытов так же, как и вероятность с частотой события, т.е. при увеличении числа опытов среднее арифметическое значение стремится к МО.

Для непрерывной СВ МО определяется по формуле

.

.

Физически МО можно трактовать как координату центра тяжести тела (плотности вероятности). Единица измерения МО соответствует единице измерения СВ.

Моменты. Дисперсия.

Среднеквадратическое отклонение.

Начальным моментом s-го

порядка для дискретной СВ X

называется сумма вида

.

Для непрерывной СВ –

.

Для непрерывной СВ –

.

.

Из этих формул видно, что

МО есть не что иное, как первый начальный

момент СВ X.

Условно, используя знак МО, можно записать

выражение для s-го

начального момента, т.е.

– начальным моментом s-го

порядка СВ X

называют МО s-й

степени этой СВ.

– начальным моментом s-го

порядка СВ X

называют МО s-й

степени этой СВ.

Центрированной СВ,

соответствующей СВ X,

называют отклонение СВ X

от ее МО, т.е.

.

Нетрудно убедиться, что МО центрированной

СВ равно нулю. Моменты центрированной

СВ называют центральными

моментами. Таким образом,

центральным моментом s-го

порядка называют МО s-й

степени центрированной

СВ:

.

Нетрудно убедиться, что МО центрированной

СВ равно нулю. Моменты центрированной

СВ называют центральными

моментами. Таким образом,

центральным моментом s-го

порядка называют МО s-й

степени центрированной

СВ:

.

Для непрерывной СВ s-й

центральный момент выражают интегралом:

.

Для непрерывной СВ s-й

центральный момент выражают интегралом:

.

.

Введем соотношения,

связывающие центральные и начальные

моменты различных порядков:

;

;

;

;

;…

;…

Из всех моментов чаще

всего в статистической радиотехнике

применяют МО и вторые моменты – начальный

и центральный. Второй центральный момент

называют дисперсией

СВ X.

Для нее вводят специальное обозначение

,

или D>X>.

,

или D>X>.

Дисперсия характеризует

степень разбросанности (или рассеивания)

СВ X

относительно математического ожидания

и имеет размерность квадрата СВ X.

На практике удобнее пользоваться

величиной, размерность которой совпадает

с размерностью СВ. Для этого из дисперсии

извлекают квадратный корень. Полученную

величину называют среднеквадратическим

отклонением (СКО). Ее обозначают через

.

При извлечении квадратного корня из

второго начального момента получается

величина, названная среднеквадратическим

значением (СКЗ). Часто используют формулу,

связывающую основные моменты:

.

При извлечении квадратного корня из

второго начального момента получается

величина, названная среднеквадратическим

значением (СКЗ). Часто используют формулу,

связывающую основные моменты:

.

.

Третий центральный момент

служит для характеристики асимметрии

(или «скошенности») плотности вероятности.

Если плотность вероятности симметрична

относительно МО, то все моменты нечетного

порядка равны нулю. Поэтому естественно

в качестве характеристики асимметрии

плотности вероятности выбрать какой-либо

из нечетных моментов, из них простейший

.

Но чтобы иметь безразмерную величину,

этот момент делят на куб среднеквадратического

отклонения

.

Но чтобы иметь безразмерную величину,

этот момент делят на куб среднеквадратического

отклонения

.

Полученная величина носит название

коэффициента асимметрии

или просто асимметрии,

обозначают ее через S>k>:

.

Полученная величина носит название

коэффициента асимметрии

или просто асимметрии,

обозначают ее через S>k>:

.

.

Четвертый центральный

момент служит для характеристики так

называемой «крутости» (островершинности

или плосковершинности) плотности

вероятности. Эти свойства распределения

описываются с помощью так называемого

эксцесса:

.

Число 3 вычитается из отношения

.

Число 3 вычитается из отношения

потому, что для весьма распространенного

в природе нормального закона это

отношение равно трем.

потому, что для весьма распространенного

в природе нормального закона это

отношение равно трем.

Кроме рассмотренных

моментов, используют иногда абсолютные

моменты (начальные и

центральные):

;

;

.

Из них чаще всего применяют первый

абсолютный центральный момент

.

Из них чаще всего применяют первый

абсолютный центральный момент

,

называемый средним

арифметическим отклонением.

Его используют наряду со среднеквадратическим

отклонением для характеристики

рассеивания СВ, для которых не существует

дисперсии.

,

называемый средним

арифметическим отклонением.

Его используют наряду со среднеквадратическим

отклонением для характеристики

рассеивания СВ, для которых не существует

дисперсии.

Кроме таких характеристик, используются понятия мода и медиана плотности вероятности. Модой (М) называют наиболее вероятное значение, соответствующее максимуму плотности вероятности (если таких максимумов несколько, то распределение называют полимодальным). Медиана (Ме) – это такое значение СВ X, для которого P(X < Me) = P(X > Me). В случае симметричного одномодального (унимодального) распределения медиана совпадает с МО и модой.

Распределение Лапласа (двухсторонний экспоненциальный):

,

,

где – МО; – характеризует степень разбросанности X относительно .

2. Биномиальное распределение (Бернулли):

.

.

Например, это распределение используется для определения вероятностей правильного обнаружения и ложной тревоги по пачке импульсов при заданных вероятностях обнаружения и вероятности ложной тревоги одного импульса в пачке.

3. Закон равномерной плотности вероятности.

Пример.

Погрешность измерения напряжения с

помощью вольтметра с дискретной шкалой

((a

– b)/2

– половина деления). МО есть (a

+ b)/2;

дисперсия – (a

– b)2/12;

среднеквадратическое отклонение (a

– b)/(2 ).

).

4. Нормальный (Гаусса) закон. Самый распространенный в природе:

.

.

Центральные моменты:

;

;

;

;

;

;

и т.д. Следовательно, S>k>

=0; Ex

= 0. Для нормального закона при нахождении

вероятности попадания случайной точки

на заданный участок оси x

имеются таблицы так называемого интеграла

вероятностей; их несколько

для различных выражений, например:

и т.д. Следовательно, S>k>

=0; Ex

= 0. Для нормального закона при нахождении

вероятности попадания случайной точки

на заданный участок оси x

имеются таблицы так называемого интеграла

вероятностей; их несколько

для различных выражений, например:

(для m

= 0 и

= 1). При определении вероятности попадания

на участок от а

до b

получим

(для m

= 0 и

= 1). При определении вероятности попадания

на участок от а

до b

получим

.

Интерес для практики представляет

определение вероятности попадания в

интервал, заданный в единицах

среднеквадратического отклонения,

например, 3.

Так, например, эта вероятность есть

0,997. Отсюда следует так называемое

«правило 3».

Для нормальных СВ это правило позволяет

на практике приближенно вычислять .

Например, при определении динамического

диапазона магнитофона с помощью

осциллографа при отсутствии вольтметра.

.

Интерес для практики представляет

определение вероятности попадания в

интервал, заданный в единицах

среднеквадратического отклонения,

например, 3.

Так, например, эта вероятность есть

0,997. Отсюда следует так называемое

«правило 3».

Для нормальных СВ это правило позволяет

на практике приближенно вычислять .

Например, при определении динамического

диапазона магнитофона с помощью

осциллографа при отсутствии вольтметра.

Все остальные законы плотности вероятности непрерывных СВ образованы преобразованием равномерного или нормального законов, например:

– закон Симпсона

(треугольный). Дисперсия

.

Свертка двух равномерных законов

соответствует плотности вероятности

суммы двух независимых равномерно

распределенных случайных величин;

.

Свертка двух равномерных законов

соответствует плотности вероятности

суммы двух независимых равномерно

распределенных случайных величин;

– закон Рэлея (корень квадратный из суммы квадратов двух СВ, распределенных по нормальному закону)

.

.

Распределение модуля комплексной случайной величины при нормальных распределениях действительной и мнимой составляющих подчиняется этому закону (распределение огибающей узкополосного случайного процесса).

Гистограмма. По оси абсцисс откладываются разряды (интервалы шириной l), и на каждом из них как на основании строится прямоугольник, площадь которого равна частоте для данного разряда (оценке вероятности попадания значений в данный разряд – отношение числа попаданий в разряд к общему числу испытаний). Для построения гистограммы нужно частоту для каждого разряда разделить на его длину и полученное число взять в качестве высоты прямоугольника. Очевидно, что площадь всех прямоугольников равна

При увеличении числа измерений N ширину l интервалов можно уменьшать (увеличивать их число m). По мере увеличения N и уменьшения l гистограмма будет приближаться к графику плотности вероятности величины X. То есть гистограмма является «портретом» плотности вероятности. Для получения «хорошего портрета» необходимо при заданном N рационально выбрать число интервалов. При малом числе интервалов плотность вероятности будет описываться слишком грубо, по мере увеличения числа интервалов будет выявляться тонкая структура плотности вероятности. Но при слишком большом числе интервалов «портрет» снова существенно исказится: появятся неравномерности, не закономерные для исследуемой плотности вероятности (в интервалы попадет мало результатов измерений, и элемент случайности приведет к искажениям).

Числовые характеристики распределения. Среднее арифметическое наблюдаемых значений:

.

.

При увеличении N статистическое среднее стремится к МО. Аналогично оценивается дисперсия – это среднее арифметическое квадрата центрированной СВ, т.е.

,

где

,

где

.

.

Таким же образом определяются другие статистические характеристики, например: определение плотности вероятности по гистограмме.

Задача эта в значительной

мере неопределенная, так как сложно

подобрать плотность вероятности,

отвечающую модели СВ, т.е. исходя из

какого критерия можно гистограмму

заменить подходящей плотностью

вероятности. Более строго, но со

значительными допущениями решается

эта проблема с помощью критериев

согласия, а сейчас воспользуемся более

простыми соображениями: сначала

производим анализ вида гистограммы,

сравнивая ее с известными законами

распределения, а затем, подбирая параметры

этого закона, будем добиваться наибольшего

визуального сходства сглаженной

гистограммы с кривой подобранной

плотности вероятности. Например, если

график сглаженной гистограммы по виду

близок к нормальному закону, то

рассчитанные по результатам измерений

оценки МО и

можно использовать для построения

нормальной плотности вероятности и

считать ее соответствующей анализируемой

выборке СВ.

можно использовать для построения

нормальной плотности вероятности и

считать ее соответствующей анализируемой

выборке СВ.

теория вероятности теорема дисперсия

Библиографический список

Математические основы современной радиоэлектроники [Текст] / И.А. Большаков [и др.]. – М. : Сов. радио, 2009. – 208 с.

Гоноровский, И.С. Радиотехнические цепи и сигналы [Текст] / И.С. Го-норовский. – М. : Радио и связь, 2006. – 608 с.

Манжос, В.Н. Теория и техника обработки радиолокационной информа-ции на фоне помех [Текст] / Я.Д. Ширман, В.Н. Манжос. – М. : Радио и связь, 2011. – 416 с.

Фомичев, К.И. Моноимпульсная радиолокация [Текст] / А.И. Леонов, К.И. Фомичев. – М. : Сов. радио, 2010. – 370 с.

Федосов, В.П. Статистическая радиотехника [Текст] : конспект лекций / В.П. Федосов, В.П. Рыжов. – Таганрог : Изд-во ТРТИ, 2008. – 76 с.